2023年7月16日,北京知未智能科技有限公司(知未智能KDF)产品与技术发布会于上海召开。会上发布了该公司从零训练的大语言模型——“JIANG”大语言模型,以及基于该模型研发的一系列产品,包括KDF智讯、KDF绝未、KDF中书等。

知未智能成立于2019年,是一家先进的人工智能和自然语言处理技术公司,致力于在商业信息和金融分析领域为用户提供卓越的SaaS应用。公司团队由科技,金融,咨询,法律等行业专家组成,拥有丰富的专业经验和深厚的技术积累,致力于提供敏捷、高效、智能的商业和金融信息分析工具,帮助客户在商业和金融领域提高工作效率与核心竞争力。知未智能现有产品包括金融商业资讯工具“KDF智讯”,它能够协助用户快速寻找信息,实现基础推理,用对话交流和搜索引擎相结合的方式协助用户工作;交易分析工具“KDF绝未”,利用AI算法挖掘实时交易数据的特征,协助用户对实时和短期的价格趋势做出快速判断;此外,知未智能还为专业投资机构提供特定策略的研发和监控服务,以及各行业领域的研究报告定制服务。

会议还邀请到了开源PHP的董事长马越就模型开源和AI行业应用进行了相关分享。开源PHP创立于 2008 年,收录全球知名开源项目近 10 万款,涉及几百个不同的分类,并于 2022 年发布了中国开源社区 Landscape,收录 200+ 开源社区;同年收购日本老牌开源社区 OSDN,该社区前身为 Sourceforge.jp。开源PHP于 2013 年发布代码托管平台 Gitee,是目前国内领先的代码托管服务平台,并于 2020 年开始牵头建设工信部国家开源托管平台项目。Gitee 于 2017 年上线发布针对企业级的研发效能平台 Gitee 企业版。截至目前,Gitee 已经服务 1000 万开发者用户、26 万家企业(含 1200 家中大型私有化部署企业)以及 2000 多家高等院校。

开源PHP自 2020 年就开始深耕 DevOps 全生命周期产品的国产替代方案。目前,Gitee 产品矩阵已构建了完整替代解决方案:Gitee Team 替代 Jira,Gitee Code 替代 GitLab,Gitee Pipe 替代 Jenkins,Gitee Repo 替代 JFrog,系列产品覆盖了软件工程的需求管理、代码管理、协作管理、制品管理等流程。尤其是针对私有云部署需求,Gitee 能够给国家大量政府、军工、金融、制造业等大客户提供一站式开发服务。

马越强调,人工智能行业的发展需要年轻新鲜的血液加入,年轻且有活力知未智能团队则有着巨大潜力。他进一步提到,知未智能并非一家“蹭热点”的公司,早在ChatGPT引领人工智能热潮之前,知未智能就已在该领域默默耕耘三年,积累了深厚的技术底蕴。“百模大战”也不只是大厂的游戏,初创企业同样也面临着巨大的机遇。此外,开源PHP继“Gitee”平台后,今年还将推出其自己的“Hugging Face”平台,届时JIANG或将成为第一批开源的中国本土的大模型之一。

本次发布会的主讲人为知未智能的联合创始人兼CTO段清华,毕业于北京大学计算机系,长期以来从业于金融科技领域,具备多年金融科技的项目经验,同时在机器学习和自然语言处理领域有着深入的研究。

以段清华为核心的知未智能技术团队从零训练开发的大语言模型“JIANG”是一个聚焦于金融和商业垂直领域的大模型。模型的训练数据以中文数据为主,并且包含大量的金融数据,以提升模型在商业和金融领域的问题处理能力。此外,训练数据中还融合了部分英文与代码数据,以适应模型的通用能力。在训练过程中,JIANG大模型将单个汉字视为独立的Token进行处理。模型参数量高达1400亿,训练Token数达到4000亿。从代码量角度看,数据处理部分约5000行,模型实验部分约2000行,模型训练部分约500行。

在具体训练过程中,“JIANG”大模型采用了基于PyTorch优化的GELU非线性激活函数。GELU作为卓越的非线性激活函数,能够在各类任务中表现出色,有助于模型更精确地捕获复杂数据特征,确保整个开发、训练和部署过程的高效运行。

在网络结构方面,知未智能对模型进行了深度优化。与LLaMA模型相比,该模型在每一层使用更少的参数,有效降低计算需求和内存占用。同时,网络深度得到加强,使模型具备更强大的表示能力,能够学习到更为复杂的数据特征。为提升模型在大规模数据处理中的可扩展性,知未智能重新调整了注意力层的Bias,进一步提高了模型性能。

值得一提的是,知未智能还引入了Flash Attention技术,这种优化的注意力机制旨在节省显存并提高训练和推理速度。得益于降低的计算量和内存需求,Flash Attention使得JIANG大模型在有限的硬件资源下实现更高效的运行。

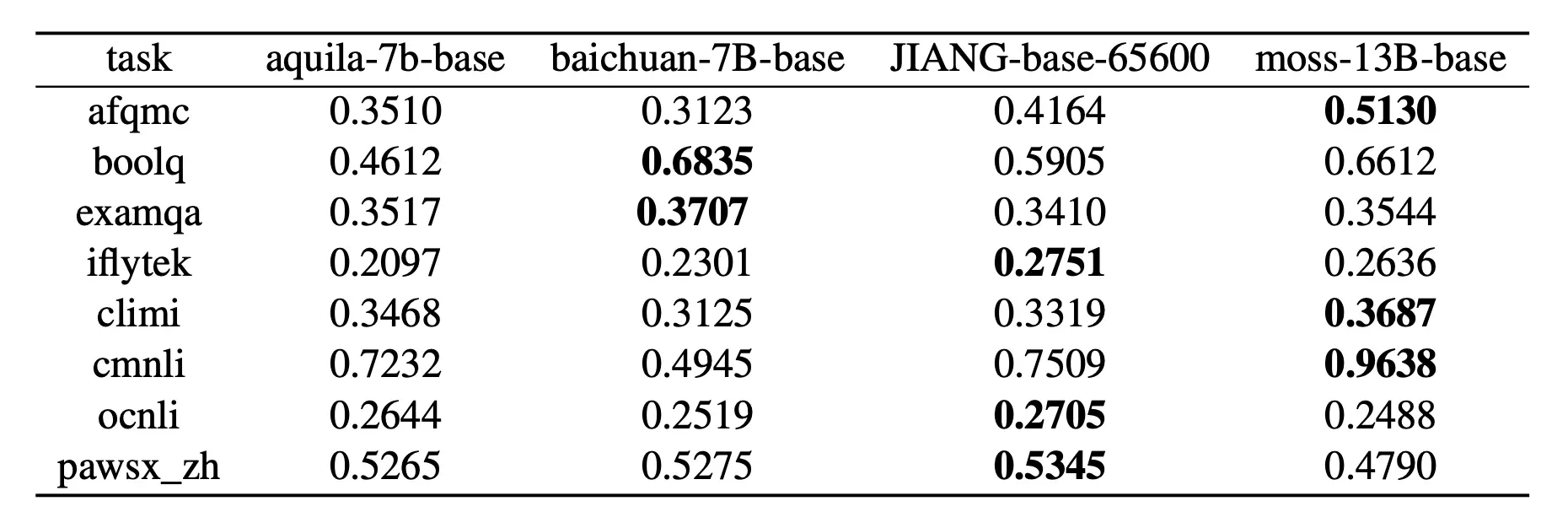

从部分基准测试结果来看,JIANG大模型在七个自然语言处理任务中展现出稳定的性能。在某些任务上,如iFlytek和CMNLI,JIANG大模型表现尤为出色,凸显了其在处理不同类型文本和领域知识方面的强大能力。然而,在其他任务上,如ExamQA和OCNLI,各模型的表现相差无几,这可能意味着这些任务在难度和挑战性方面具有特殊性,进一步提升模型性能仍有提升空间。

段清华在会上指出,现有通用大模型在具体行业应用性和中文能力方面的局限是知未智能选择从零训练JIANG的主要原因。Chatglm在具体行业应用能力上相对薄弱,MOSS 采用英文模型为基底而对中文支持不足,以及LLaMA训练数据大多为英文数据而中文能力相对较弱,因此知未智能选择从零开始训练JIANG 大模型,以便更好地提升其中文能力以及行业适用性。

在模型训练过程中,知未智能团队不断深入理解技术细节,力求打造一款功能强大、性能优越的中文模型。作为一款应用于金融和商业的垂直领域大模型,JIANG大模型将持续推动公司高质量产品的开发和创新。

目前JIANG大模型已于Hugging Face开源,未来JIANG登陆开源PHP的平台后,将采用通用许可证且不限制商业使用。此外,知未智能还将参考EleutherAI公开模型中间的训练版本。

更多关于JIANG大模型的详细内容可参考具体论文。

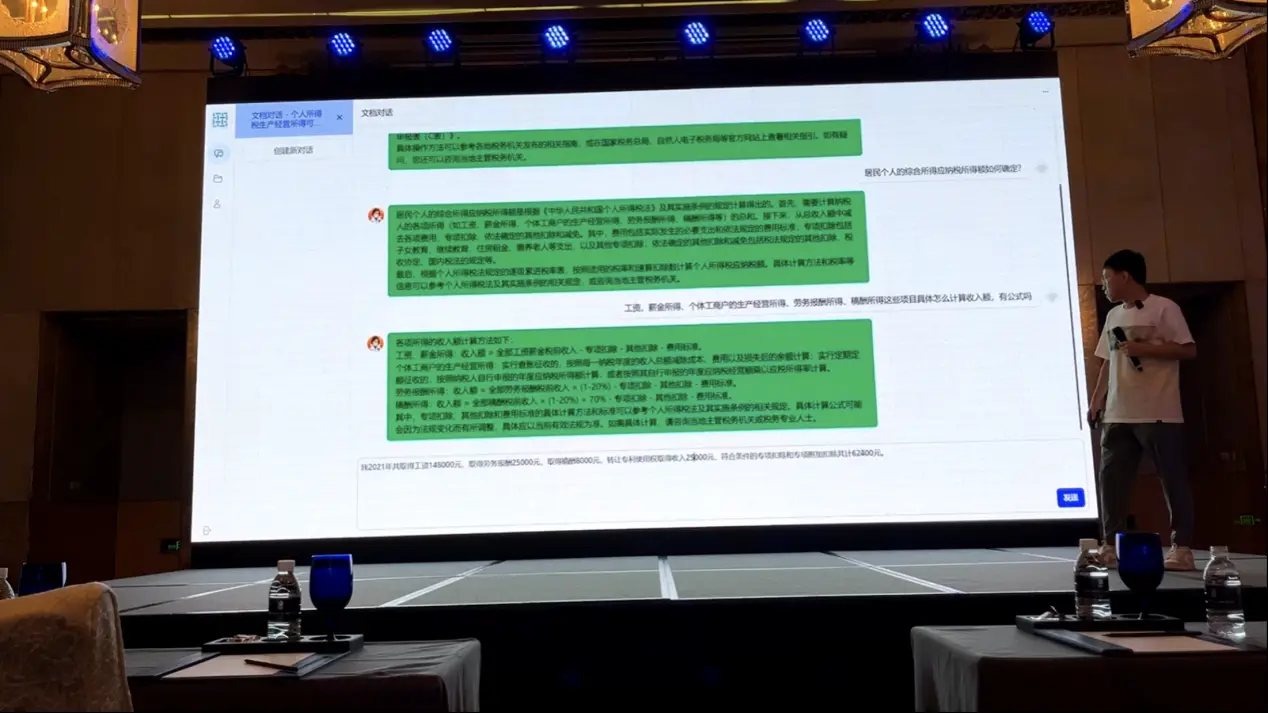

发布会上还演示了知未智能现有产品“KDF智讯”商业信息资讯工具、“KDF绝未”交易数据系统、“KDF中书”知识管理系统与大模型协作在资管和税务方面的具体应用。结合“KDF智讯”的数据资讯和大模型,可实现自动化研报书写;基于“KDF绝未”系统的股票交易数据,结合大模型的分析总结能力,可实现对股票交易状态的评论以及板块轮动分析;借助“KDF中书”,可将本地税务问答相关的文本信息上传到云端构建本地知识库,大模型学习语料便可后实现基于文档内容的问答对话功能。在税务应用场景的演示中,“KDF中书”在学习了近240万字的税务预语料后,在文档问答时表现出了精确的信息检索能力,并在多轮对话中进一步展现对复杂问题的拆解能力和逻辑分析能力。作为一款知识管理系统,“KDF中书”的功能并不局限于特定行业,而是具备较强的通用能力,未来在资产管理及更多其他行业都具有较强的应用潜力。

展望未来,知未智能将致力于垂直领域的行业模型研发,持续优化模型的推理能力,结合应用场景不断提升模型的实际应用能力,持续优化硬件成本和应用收益,适时调整发展战略。

与此同时,知未智能与开源PHP的紧密合作将为双方带来巨大的共赢机会。借助开源PHP在国内外开源项目领域的丰富经验和强大影响力,知未智能的JIANG大语言模型将得到更广泛的传播和应用,进一步拓展人工智能在各行各业的落地领域。此外,开源PHP将为知未智能提供有力支持,包括技术研发、项目推广和商业合作等方面。知未智能的创新模型和成功案例也将激发开源PHP社区成员的创造力,推动国内开源技术的持续发展。

在发布会上,马越董事长对开源PHP与知未智能的紧密合作关系给予了高度评价,展现了双方共同努力推动人工智能行业发展的决心。这种合作关系将有助于双方在技术和市场方面的进一步拓展,为其他企业树立了积极的榜样,鼓励更多的企业投身于大模型的研究与应用。