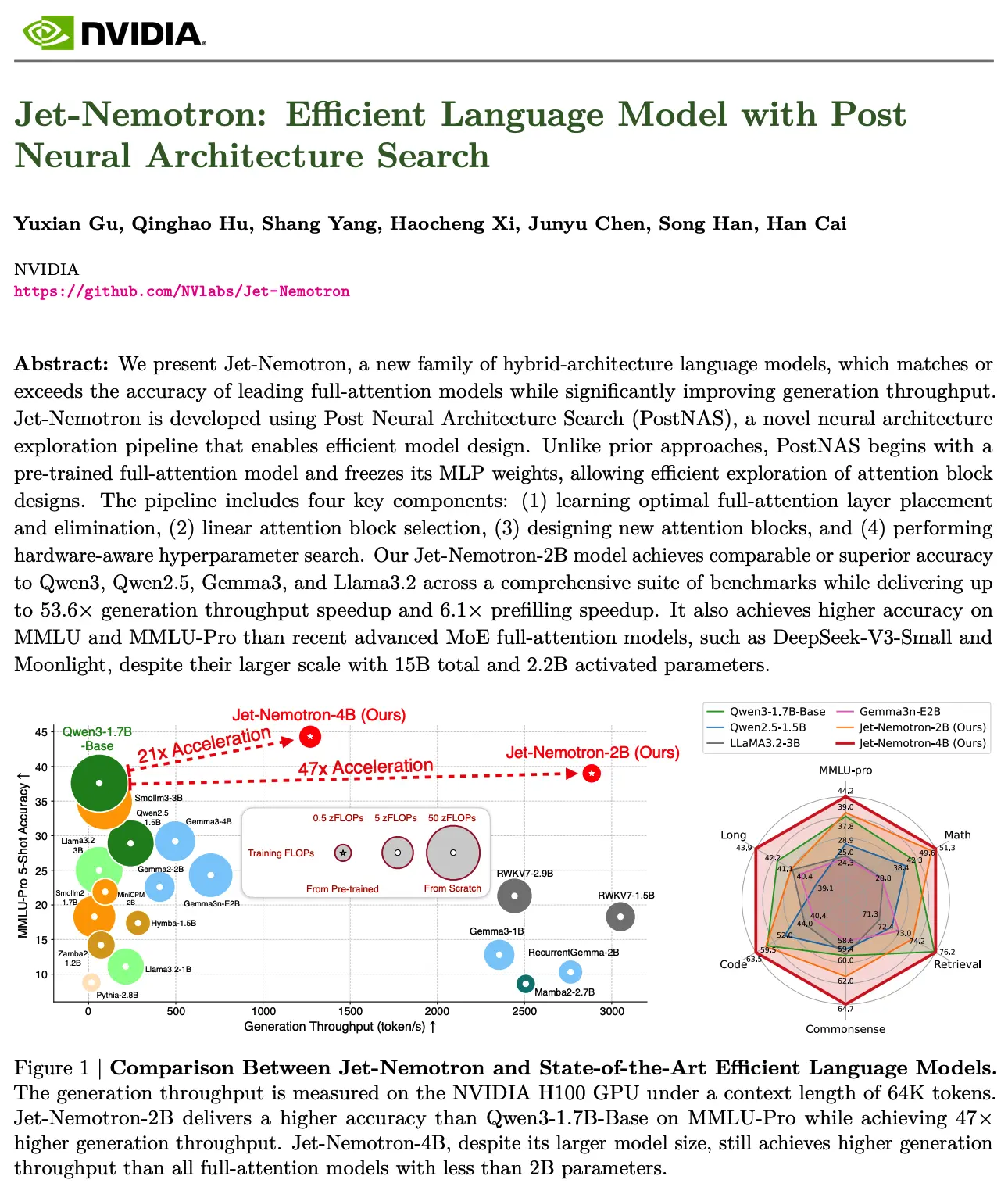

英伟达研究团队发布了Jet-Nemotron,这是一个新一代的混合架构语言模型系列。该系列通过Post Neural Architecture Search (PostNAS)流程,在冻结预训练全注意力模型MLP权重的前提下,仅对注意力模块进行高效的设计探索,实现了与领先全注意力模型相当或更高的精度,同时显著提升了生成吞-吐量。

https://arxiv.org/abs/2508.15884v1

基于该流程构建的Jet-Nemotron-2B在全面的基准测试中,精度与Qwen3、Qwen2.5、Gemma3、Llama3.2相当或更优,生成阶段吞吐速度提升最高达53.6倍,预填充阶段提速6.1倍。在MMLU与MMLU-Pro基准上,其准确度也高于近期先进的MoE全注意力模型DeepSeek-V3-Small(总参数量15B)和Moonlight(激活参数量2.2B)。

Jet-Nemotron的核心创新还包括JetBlock,这是一种动态线性注意力设计,能够智能过滤值标记,性能优于Mamba2和GLA等早期线性方法。

此外,它还采用了混合注意力策略,即在保留少量全注意力层以维护推理能力的同时,将其余部分替换为JetBlock,从而显著降低内存占用并提升吞吐量。