OpenAI 昨晚宣布为其生成式 AI 模型 GPT-3.5 Turbo 和 GPT-4 发布重磅更新。

值得关注的亮点:

- Chat Completions API 中新的函数调用功能

- 更新并增加可控制性的

gpt-4和gpt-3.5-turbo版本 gpt-3.5-turbo的新 16k 上下文版本(与标准 4k 版本对比)- 最先进的嵌入模型的价格降低了 75%

gpt-3.5-turbo输入 token 的价格降低了 25%- 公布

gpt-3.5-turbo-0301和gpt-4-0314模型的弃用时间线

1. 函数调用

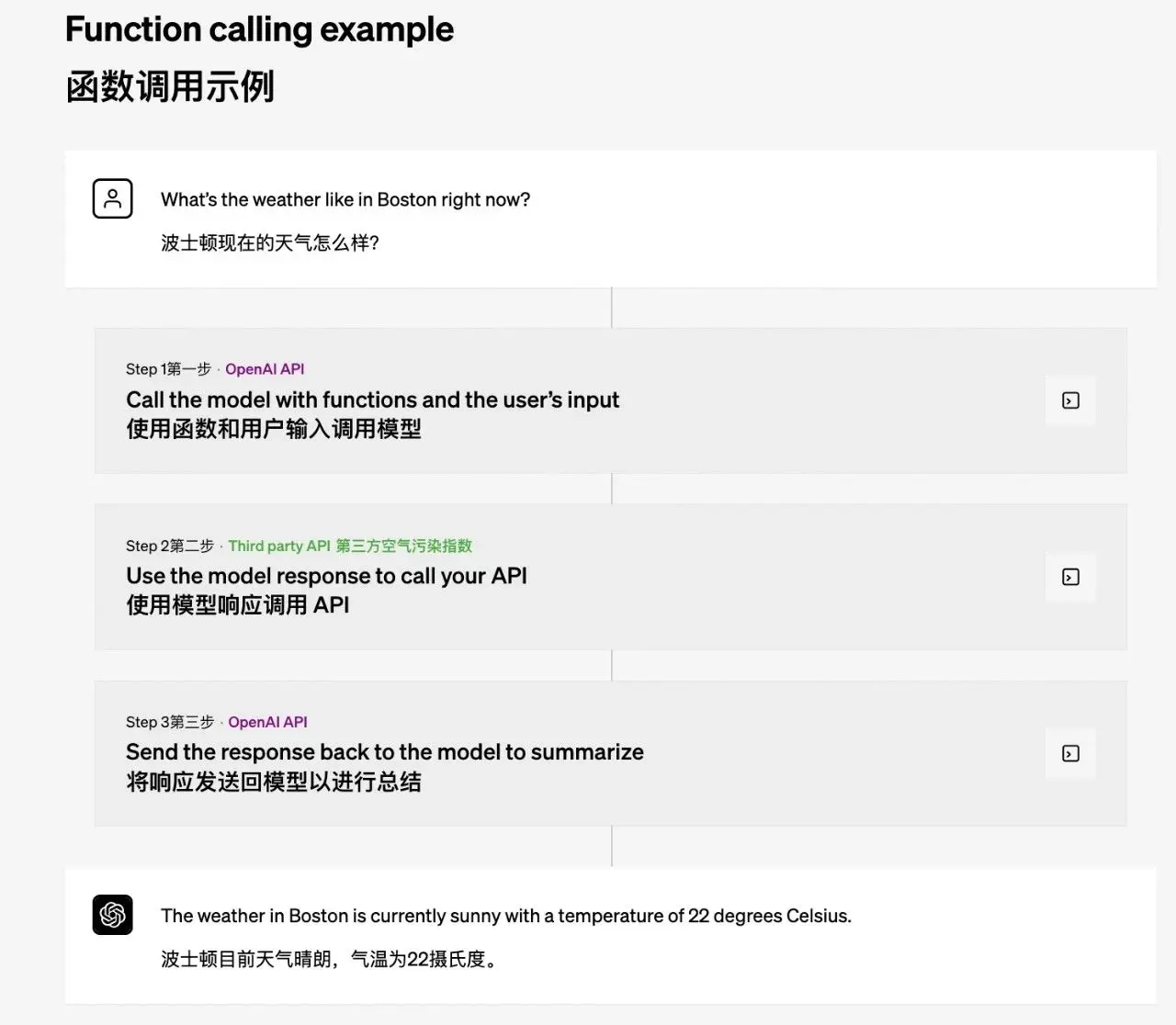

在Chat Completions API中添加了新的函数调用能力,能让模型在需要的时候调用函数并生成对应的JSON对象作为输出。这让开发人员能更准确地从模型获取结构化数据,实现从自然语言到API调用或数据库查询的转换,也可以用于从文本中提取结构化数据。

这意味着经过OpenAI的微调后,你跟它说人话,它就能识别后给你转换成函数,进一步不需要编程也能实现编程的能力了,并且还能更方便从混乱结构里获取结构化数据。

举个例子:当向 ChatGPT 提问「波士顿的天气怎么样?」时,该问题会被模型解读为调用第三方天气 API,这时候它就会去检索相关的数据,输出准确的回答。OpenAI 相当于提供了一个规范的接口调用方式,这将会给基于 GPT 开发应用的开发者们更高的灵活性。

2. 模型更新

大语言模型 (LLM) 的“上下文窗口(context window)”相当于一个短期记忆,可以存储输入的内容或者聊天机器人的对话内容。

在语言模型中,增加上下文窗口大小已经成为一种技术竞赛,Anthropic 公司最近宣布其 Claude 语言模型可以提供 75000 个 token 上下文窗口选项。此外,OpenAI 也开发了一个 32000 个 token 的 GPT-4 版本,但尚未公开推出。

OpenAI 刚刚发布的gpt-3.5-turbo-16k模型支持 16000 tokens 的上下文长度,这意味着可以一次处理大约 20 页的文本,这对于需要模型处理和生成较大文本块的开发者来说是一个很大的提升。

另外,OpenAI 此次一同发布的gpt-4-0613和gpt-3.5-turbo-0613改进模型,均支持函数调用功能,并且提升了可控制性(more steerable)。所谓可控制性是“通过系统消息更可靠地控制”的功能。系统消息是 API 中一种特殊的指令输入,可以告诉模型如何行事,例如“你是格林姆斯,你只谈论奶昔”。

3. 模型弃用

公布了gpt-3.5-turbo-0301和gpt-4-0314模型的弃用时间线。这些模型的用户可以在特定时间之前选择升级到新的模型,过了这个时间后,旧模型将不再可用。

4. 价格下降

除了功能上的改进之外,OpenAI 还大幅降低了价格。

- 嵌入模型:

text-embedding-ada-002模型的成本降低了 75%,每 1000 个标记价格为$0.0001 gpt-3.5-turbo:gpt-3.5-turbo的输入标记价格降低了 25%。现在,开发者只需支付$0.0015每 1000 个输入标记和$0.002每 1000 个输出标记的价格,相当于每美元可支持大约 700 页文本gpt-3.5-turbo-16k的价格为每 1000 个输入标记$0.003,每 1000 个输出标记$0.004

OpenAI 还强调称,所有的这些模型都继续保持在3月1日推出的数据隐私和安全保证 —— 客户拥有他们请求生成的所有输出,他们的 API 数据不会被用于训练。通过这些更新,他们将邀请更多的等待名单上的人尝试 GPT-4,期待看到更多用户使用 GPT-4 构建的项目!