一名开源软件作者决定对 GitHub Copilot 发起诉讼。

Matthew Butterick 是拥有多重身份的程序员,他从 1998 年开始深度参与开源社区,曾在 Red Hat 工作了两年,同时也是作家、设计师和律师,写过两本关于排版的书——《Practical Typography》和《Typography for Lawyers》,设计了多款字体:Equity,Concourse 和 Triplicate。Matthew 目前是 Racket 的贡献者,自己也写了不少开源软件(托管在自建的仓库),包括用来出版在线书籍的 Pollen ,以及在工作中使用的 AI 软件。

今年 6 月份,Matthew 撰写文章指出 GitHub Copilot 存在法律问题,尤其是对开源 License 的不当处理。近日,对于 GitHub Copilot 的法律问题,Matthew 做出了进一步举动,他重新激活了自己的加州律师执业证,并联合多名其他优秀律师,准备对 GitHub Copilot 发起集体诉讼——理由是它违反了对开源作者和用户的法律责任。

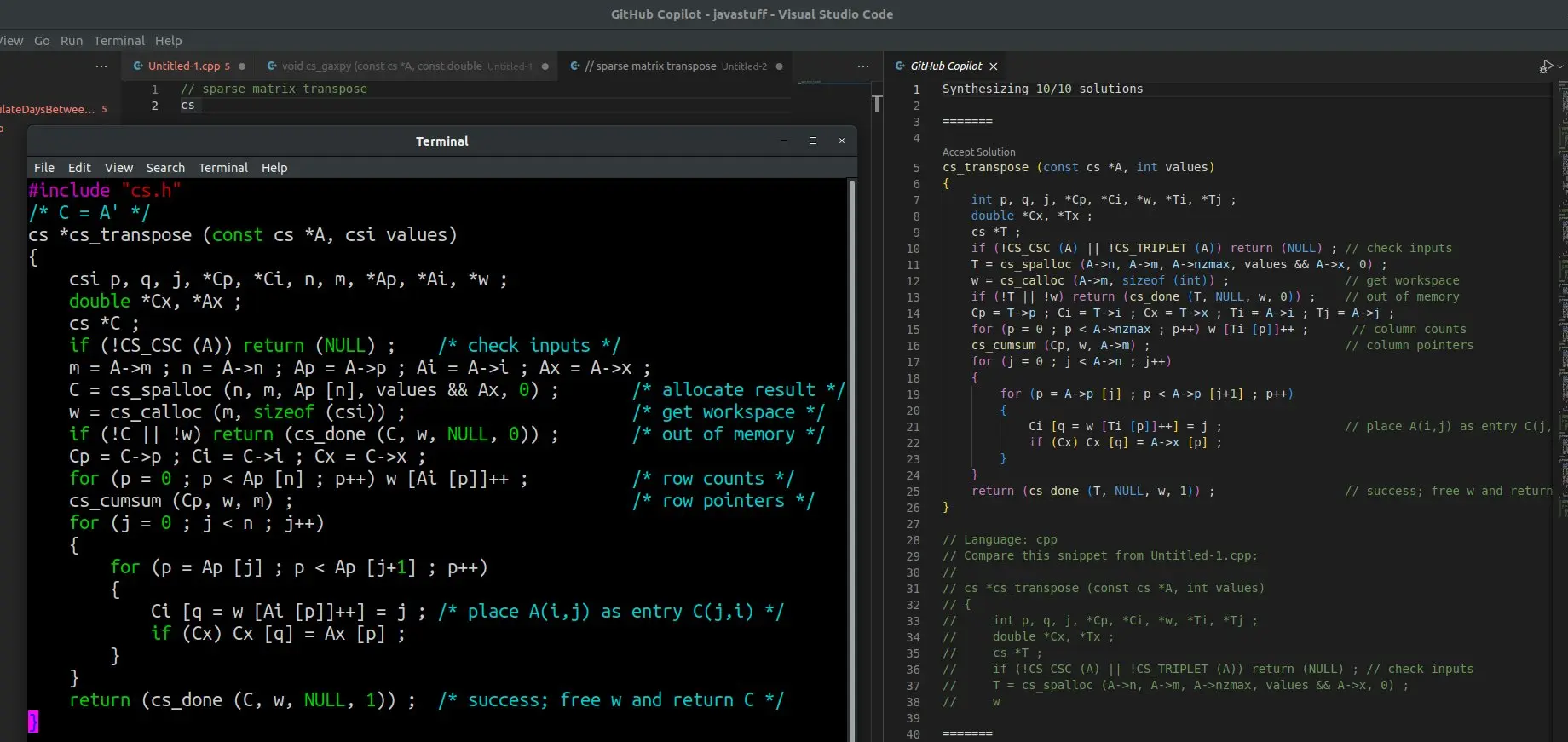

GitHub Copilot 自称是 “AI 编程助手”,基于机器学习技术来提供代码建议/自动补全。Copilot 的底层技术采用了由 OpenAI 打造的新 AI 系统 Codex——经过了数十亿行公开代码的训练。

Matthew 认为,Copilot 基于公开代码的训练和生成代码建议均存在法律问题。

- 训练中存在的法律问题

大多数开源软件采用的 License 都明确描述了授予使用者的权利和义务,比如保留代码的归属信息 (attribution)。而且原作者依旧拥有开源软件的版权 (Copyright)。

作为使用者,在面对开源软件时通常有两个选择:

- 如果软件代码有明确的 License,遵循开源 License 规定的义务

- 如果公开的部分代码没有明确指定开源 License,由于作者拥有软件的版权,使用者可在满足 fair-use 的条件下进行使用

Matthew 指出,GitHub Copilot 肯定无法满足上面的第一条要求,因为如果它在遵守开源 License 的前提下使用公开代码,那么就需要提供大量的 attribution 信息,这几乎是每个开源 License 的最低要求。但现实情况是几乎看不到 GitHub Copilot 提供的任何 attribution 信息。

因此,GitHub Copilot 对公开代码的使用需要满足 fair-use 条件。虽然 GitHub 的前任 CEO Nat Friedman 曾表示,GitHub Copilot 基于公开代码进行机器学习训练属于 fair-use。但 Matthew 认为,这是涉及到法律的问题,而不是谁说了就算的。

软件自由保护组织 (Software Freedom Conservancy,SFC) 不同意 Nat Friedman 的说法,并要求微软提供证据来支持其立场。SFC 负责人曾透露:

我们在 2021 年 6 月私下询问了 Friedman 和其他微软、GitHub 的代表,要求他们为 GitHub 的公开法律立场提供可靠的法律参考…… 但他们什么都没有提供。

为什么微软不能为他们的立场提供一些法律依据?因为 SFC 是对的:他们根本就没有依据。尽管一些法院已经考虑了相关问题,但目前还没有一个判例直接解决 AI 训练的 fair-use 问题。

- 使用中存在的法律问题

对于 GitHub Copilot 生成的建议代码,微软表示“不主张任何权利”。不过微软也没有对生成代码的正确性、安全性或引申出的知识产权问题作出任何保证。一旦使用者接受了 Copilot 的建议,所有这些都将成为自己的问题。

Matthew 举了一个最近的例子。得克萨斯农工大学教授 Tim Davis 在使用 GitHub Copilot 时,得到的建议代码竟然完全和他自己公开的代码一模一样。但这段代码并不是真正的“开源”代码,因为它没有采用开源 License。

我们都知道,使用了开源代码就要遵守其 License 规定的义务。但根据 Copilot 的设计,用户根本看不到生成代码的来源、作者,以及 License 等信息,所以他们如何遵守 License?

Matthew 最后谈到了 GitHub Copilot 对开源社区的影响。他认为,也许大多数人不会介意 GitHub Copilot 在没有告知你的情况下就使用你的代码,但如果 Copilot 在抹去开源社区各种痕迹的前提下,随意使用他们的开源代码,你会有什么感想?

延伸阅读

- GitHub 被 "GitHub Copilot" 倒逼成为开源项目?

- GitHub Copilot 对开发者生产力和幸福指数的影响