一份针对微软、GitHub 和 OpenAI 的最新投诉文件内容指出,GitHub 通过对其 Copilot 编程助手进行了细微调整,以避免一些版权指控。

具体表现为,为了回应公众对 Copilot 的批评,GitHub 在 2022 年 7 月推出了一个用户可调整的 Copilot 过滤器,名为"Suggestions matching public code"。当过滤器启用时,GitHub Copilot 会将代码建议及其周围的代码与 GitHub 上的公共代码进行约 150 个字符的检查。如果有一个匹配或接近匹配,该建议将不会提供给用户。

但原告认为,该过滤器基本上毫无价值,因为它只检查完全匹配的内容,但凡稍作修改就检测不到了。GitHub 试图通过改变 Copilot 的输出,使内容看起来不是完全复制的,来逃避版权和许可侵权行为。

“在 GitHub 的手中,Copilot 输出中微小的表面变化倾向是一个特点,而不是一个错误。这意味着 GitHub 可以向 Copilot 客户提供无限的许可材料的修改副本,而不会触发 Copilot 的 verbatim-code 过滤器......Copilot 是一种巧妙的软件盗版方法。”

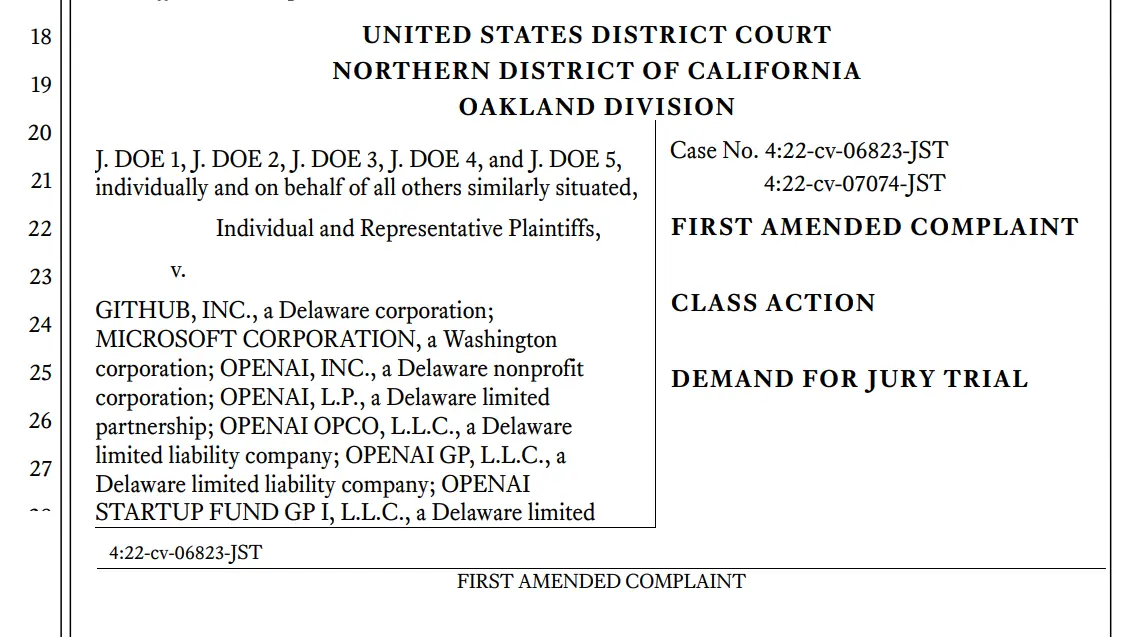

该诉讼最初于去年 11 月由四名身份不明的("J. Doe")原告提出,声称 Copilot 以违反版权法和软件许可要求的方式对公开发布的代码进行训练,并将他人的代码作为自己的代码呈现。彼时,微软、GitHub 和 OpenAI 试图驳回此案,但最终只避免了一些索赔。法官依旧保留了主要的版权和许可问题,并允许原告补充更多的证据细节。

目前,修改后的投诉文件涵盖了八项罪名,保留了对违反《数字千年版权法》(美国著作权法律)、违约(违反开放源代码许可)、不公平致富和不公平竞争方面的指控。以及增加了几项指控:违约(违反 GitHub 的政策出售许可材料),故意干扰未来的经济关系和过失干扰未来的经济关系。

修订后的起诉书中还增加了一名原告,声称 Copilot 复制了他的代码,并提供了其代码样本。且该原告的代码样本被进行了编辑,以防止身份被识别。监督此案的法官也允许原告在法庭文件中保持匿名,以防止他们受到威胁。

针对这些指控,微软发言人则进行了坚决否认,并回应称,"我们坚信,人工智能将改变世界构建软件的方式,从而提高生产力;最重要的是,让开发者更快乐。我们相信 Copilot 遵守了适用的法律,我们从一开始就致力于以负责任的方式对 Copilot 进行创新。我们将继续投资并倡导未来的人工智能驱动的开发者体验"。

OpenAI 没有回应置评请求。