2025 年 4 月 29 日,RWKV 基金会开源了 RWKV7-G1 1.5B 推理模型(Reasoning Model)。

RWKV7-G1 1.5B 具备其它同尺寸模型不具备的推理能力 和任务能力 ,同时还支持现实世界 100+ 种语言。在实际测试中,RWKV7-G1 1.5B 模型的推理逻辑性较强,能够完成有难度的多语言、数学和代码任务。

RWKV7-G1 1.5B 推理模型基于 World v3.5 数据集训练,包含更多小说、网页、数学、代码和 reasoning 数据,总数据为 5.16T tokens。

快速体验 G1 1.5B :https://huggingface.co/spaces/RWKV-Red-Team/RWKV-LatestSpace

我们也开源发布了 RWKV 模型端聊天 APP,方便大家体验 RWKV-7 模型。APP 下载链接在本文靠后位置。

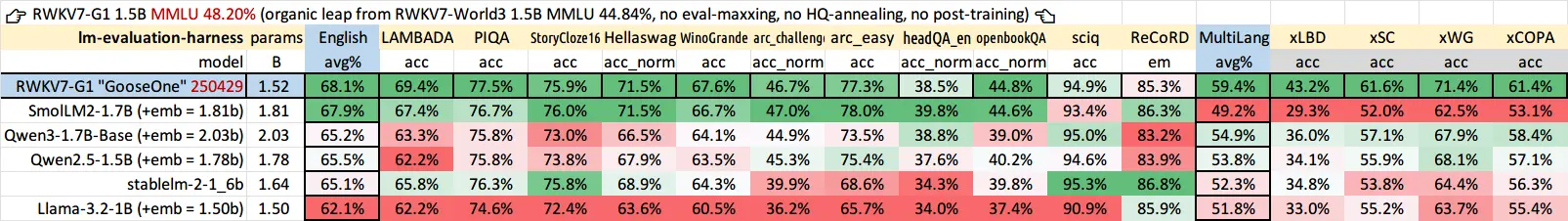

模型客观指标评测

英语和多语言能力

RWKV7-G1 1.5B 的英语和多语言能力显著强于同规模的开源模型 ,包括同期发布的 Qwen3-1.7B-Base。

此外,RWKV7-G1 1.5B 的 MMLU 准确度为 48.2%,比 RWKV-7 World 1.5B 的 44.8% 有继续提升。

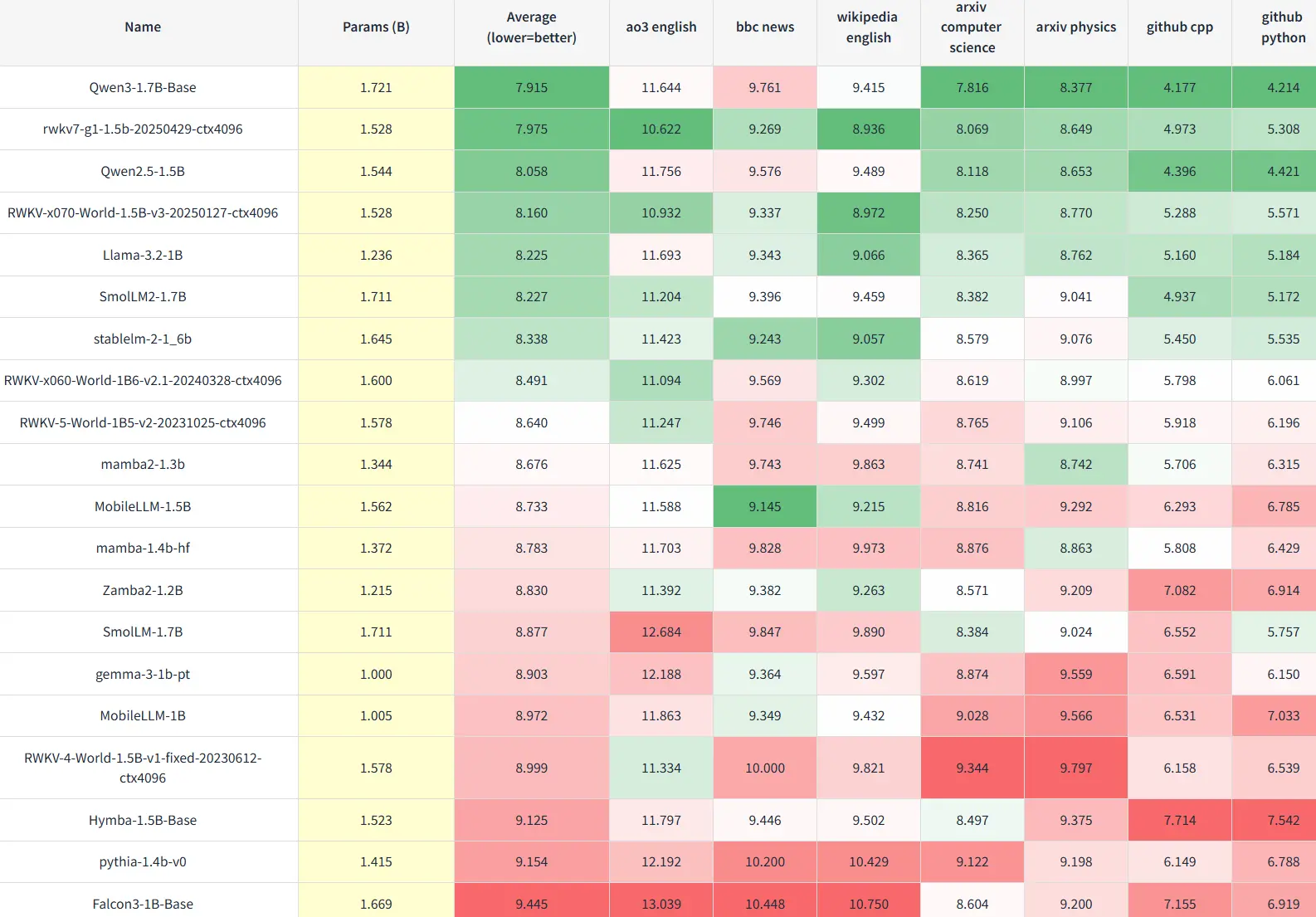

无法作弊的评测

Uncheatable Eval 是"无法作弊的评测",它使用最新的论文和新闻文章等实时数据,评估开源大语言模型的真实建模能力和泛化能力。

G1 1.5B 的 Uncheatable Eval 综合得分在同参数规模的开源模型中处于领先地位,超越 Qwen2.5-1.5B,仅次于参数更多的 Qwen3-1.7B:

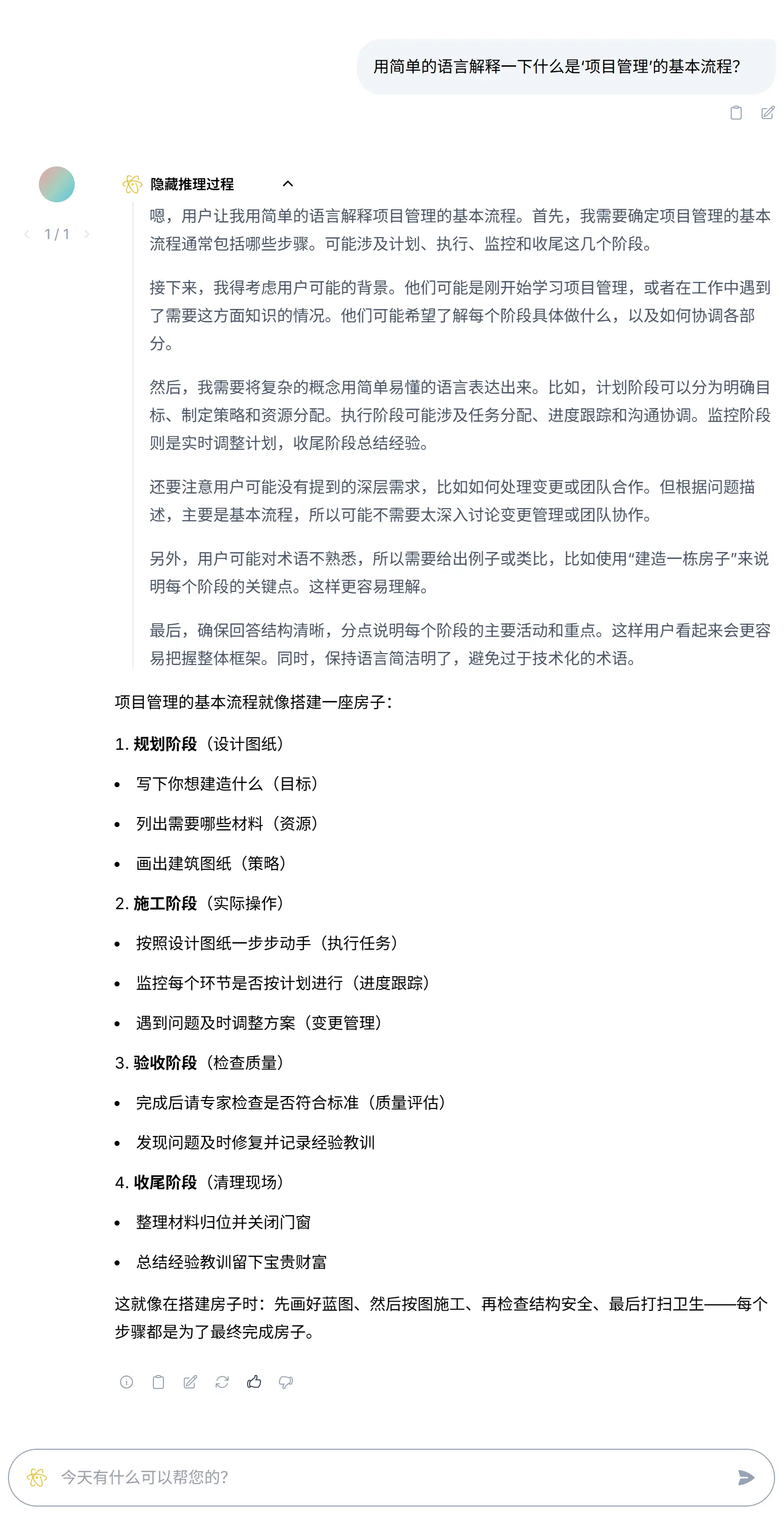

模型使用体验实测

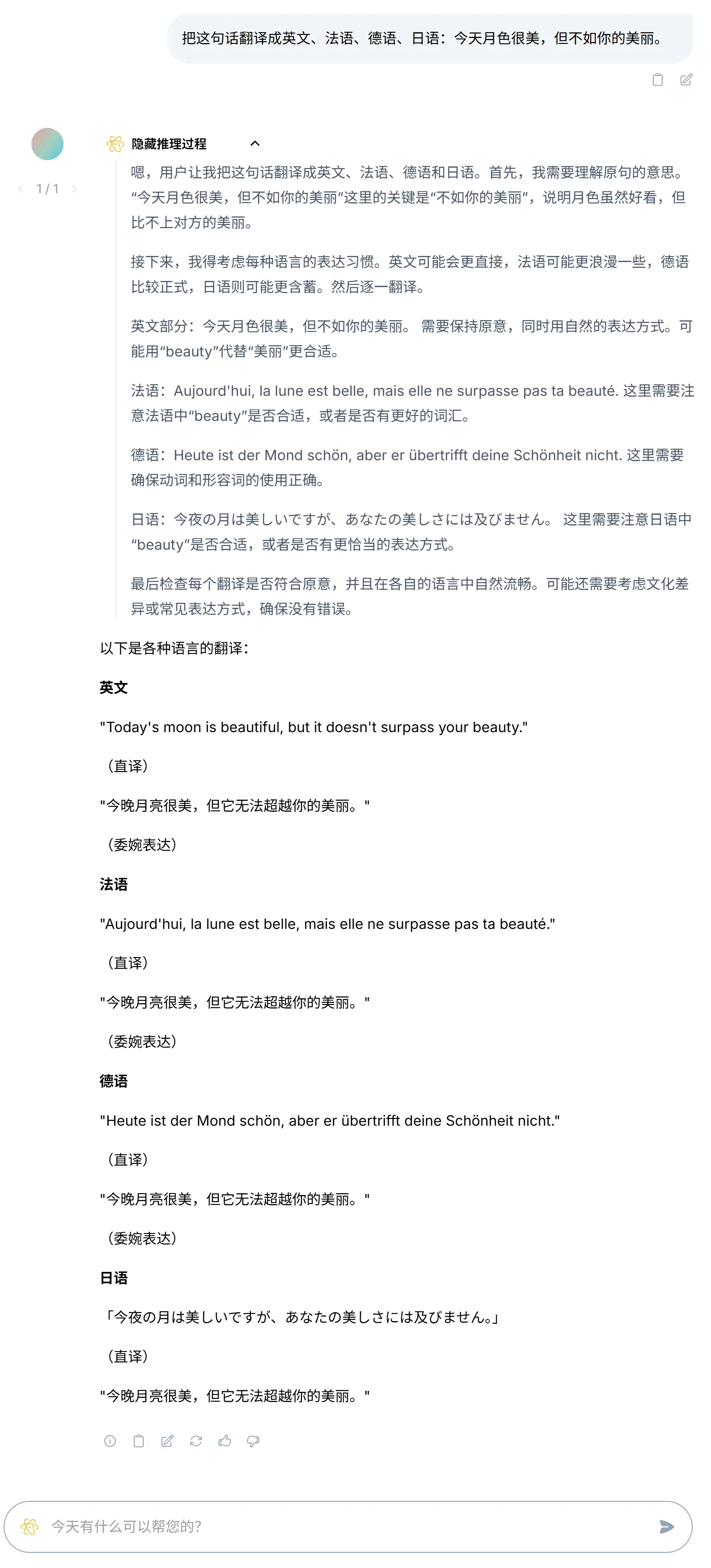

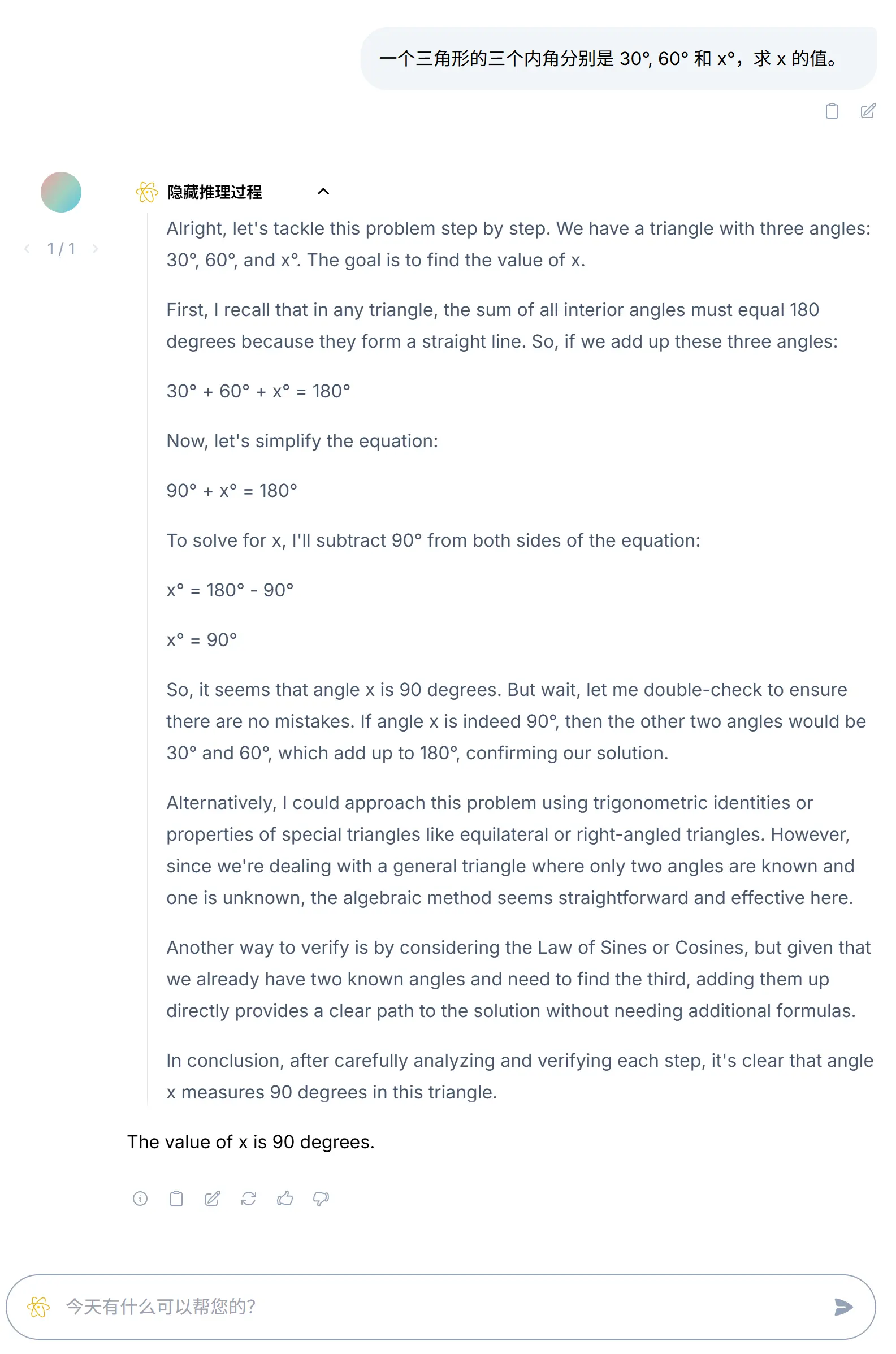

多语言能力

RWKV7-G1 1.5B 支持全球 100 多种自然语言,比同参数量的 Transformer 模型更强。

下面是 G1 1.5B 把中文翻译为多国语言的推理过程和翻译结果,翻译结果完全准确:

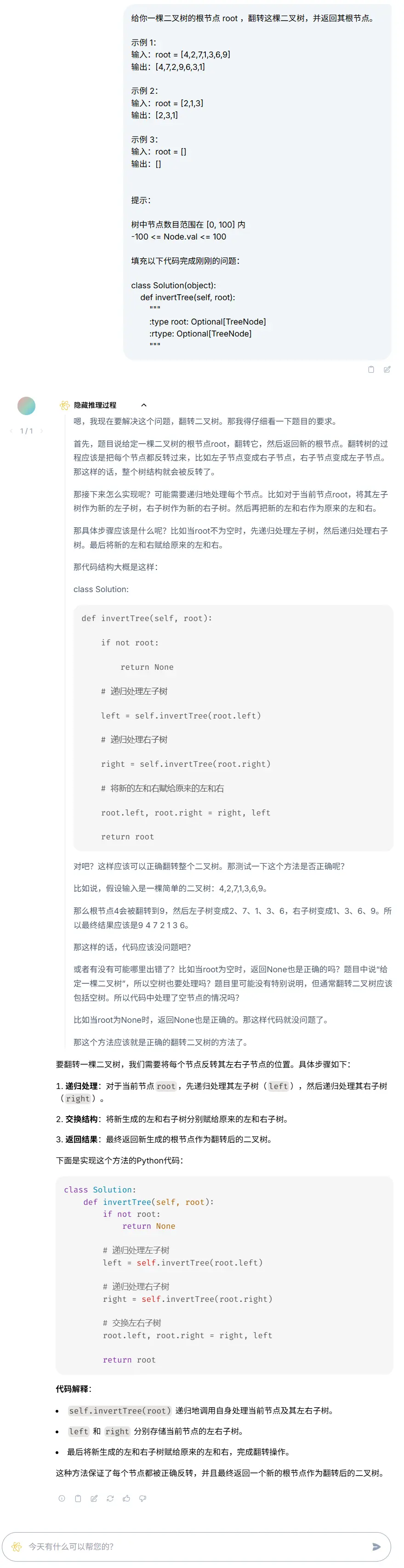

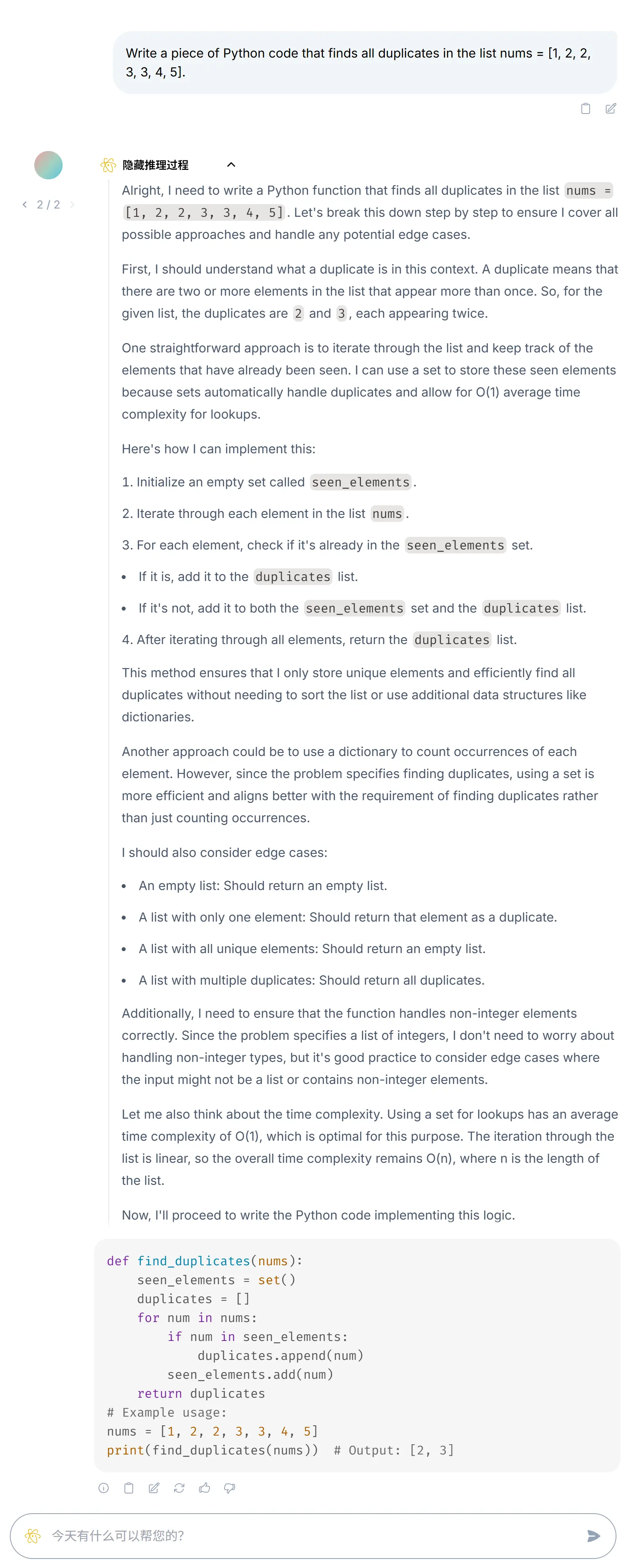

代码能力

G1 1.5B 拥有基础的代码能力,更大的 G1 2.9B/7B 模型的代码能力会显著更强。

G1 1.5B 刷 Leetcode 题目:

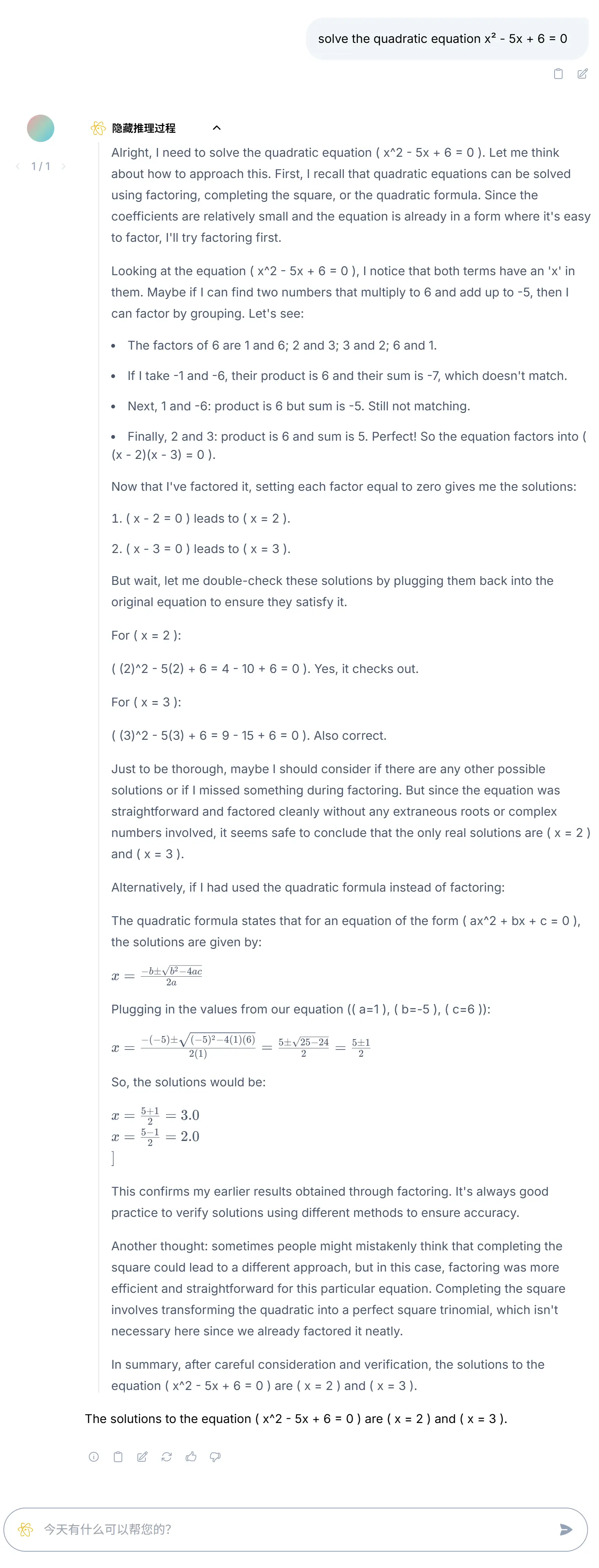

数学题目

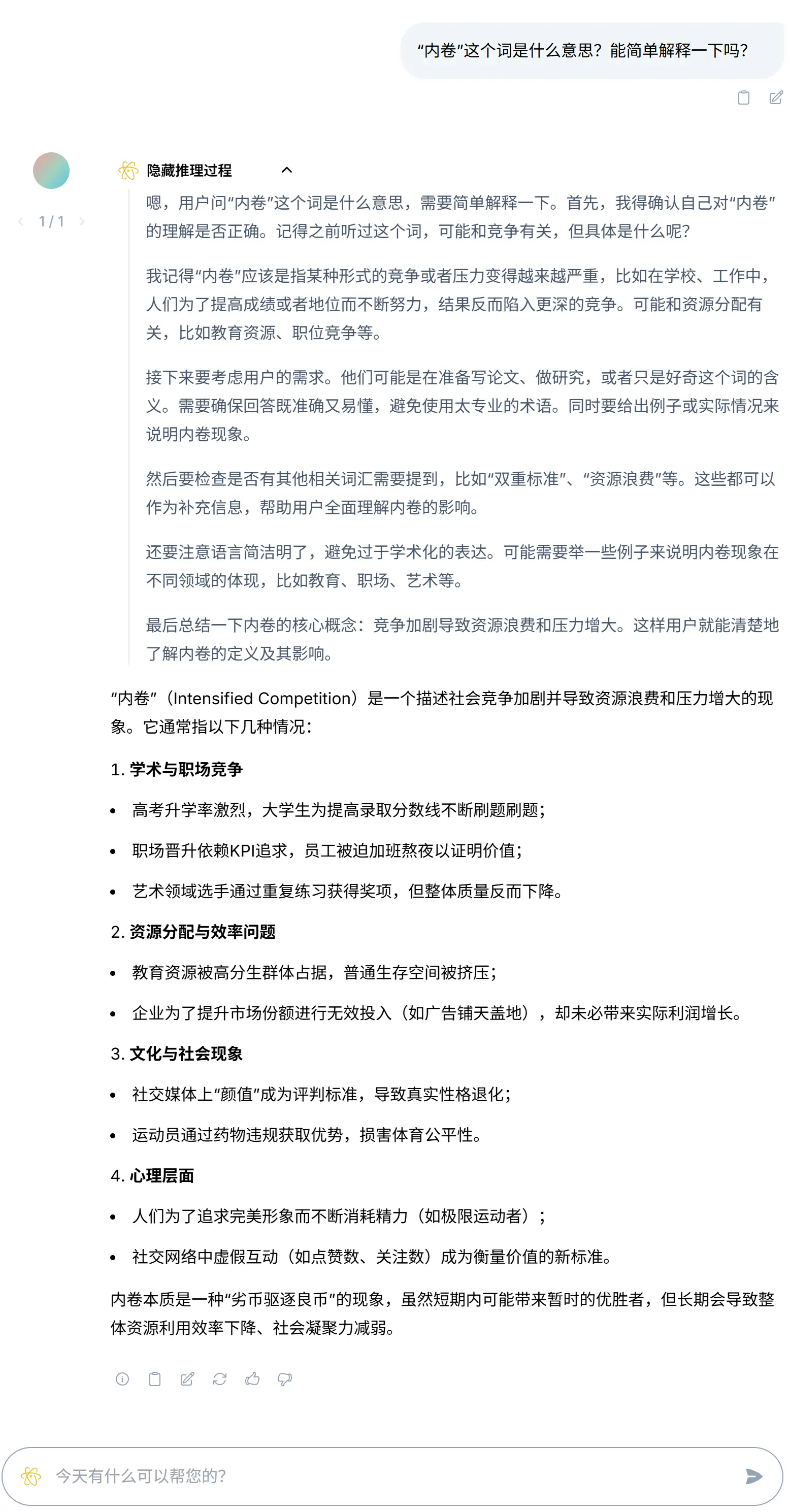

日常对话

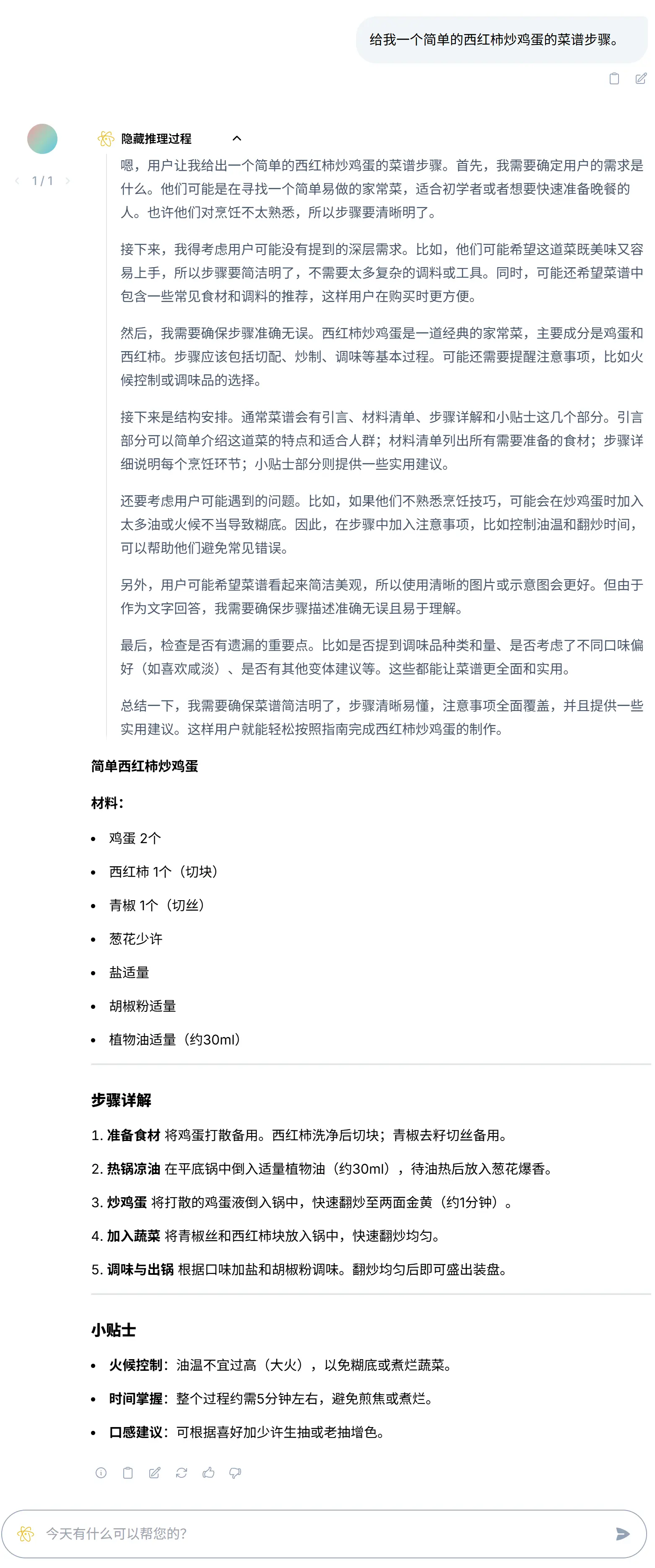

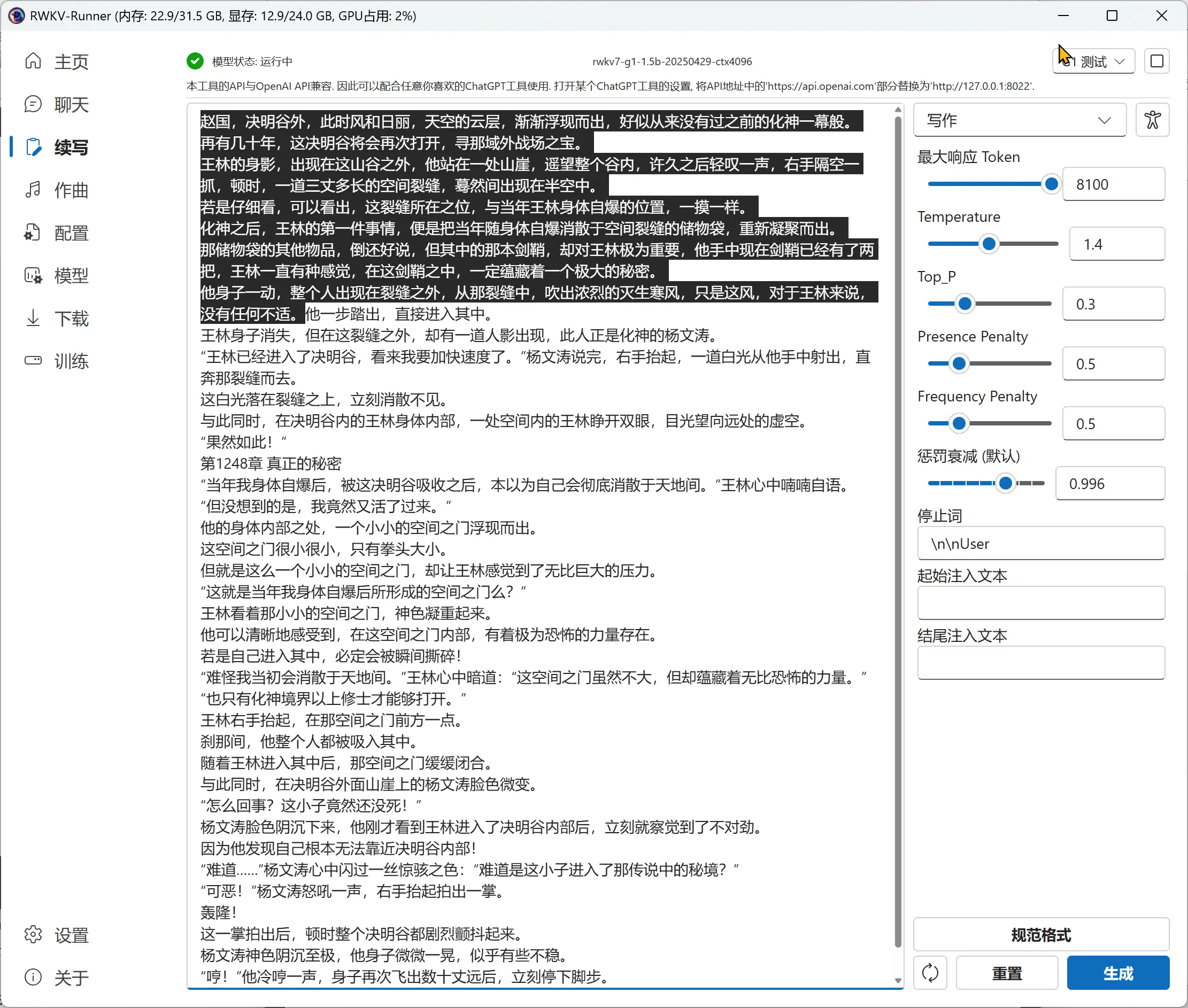

小说能力

G1 1.5B 直接续写小说,有较好的网感和文风:

模型试用

我们提供了多个 RWKV-7 模型的在线 demo,也提供移动端聊天 APP。

【推荐】用在线 demo(聊天模式)

为了方便社区体验 RWKV-G1 模型,我们提供了聊天模式的在线 demo。

- Hugging Face:https://huggingface.co/spaces/RWKV-Red-Team/RWKV-LatestSpace

- 魔搭 demo:https://modelscope.cn/studios/RWKV-Red-Team/RWKV-LatestSpace/summary

可在此体验已完成训练的 RWKV7-G1 0.1B、0.4B 和 1.5B 模型,也可以切换到其他正在训练中的 G1 模型,如 G1 2.9B。

这个精美的 RWKV 对话界面由 RWKV 社区成员 @Leon 开发,并在 GitHub 仓库 web-rwkv-realweb 中开源。

使用在线 demo(续写模式)

可以在官方 Demo 中试用 RWKV7-G1 1.5B 模型:

- **Hugging Face Gradio Demo:**https://huggingface.co/spaces/BlinkDL/RWKV-Gradio-2

RWKV7-G1 的整体 prompt 格式与 RWKV-7-World 模型类似,可选使用 <think> 标签开启 reasoning 功能:

User: 我可以抽干太平洋的水然后下去抓鱼吗?

Assistant: <think>

使用 RWKV 端侧聊天 APP

我们也开发了处于内测阶段的 RWKV 端侧聊天 APP(Android 和 iOS 版本),可在下列地址下载 APP:

- Android : https://www.pgyer.com/rwkvchat

- iOS (TestFlight) : https://testflight.apple.com/join/DaMqCNKh

贯彻开源开放的宗旨,RWKV 端侧聊天 APP 也已开源 ,在 GitHub rwkv_mobile_flutter 仓库中可以看到项目代码。

测试数据显示:经过 NPU 优化后,RWKV-7 1.5B 模型在高通 8Gen3 手机芯片实现了 62 token/s 的推理速度,G1 0.1B 模型的推理速度则高达 170 token/s。

模型下载

下载已完成训练的 RWKV7-G1 0.1B/0.4B/1.5B 模型:

- Hugging Face:https://huggingface.co/BlinkDL/rwkv7-g1/tree/main

- 魔搭社区:https://modelscope.cn/models/RWKV/rwkv7-g1/files

- WiseModel:https://wisemodel.cn/models/rwkv4fun/RWKV-7-G1/file

下载其他训练中的 RWKV7-G1 模型(G1 2.9B):

- Hugging Face:https://huggingface.co/BlinkDL/temp-latest-training-models/tree/main

- 魔搭社区:https://modelscope.cn/models/RWKV/temp-latest-training-models/files

G1 模型发布计划

当前已发布 G1 0.1B/0.4B/1.5B 模型,正在训练 G1 2.9B,具体发布计划如下:

| 模型 | 发布计划 |

|---|---|

| G1 0.1B | 3 月 8 日(已发布) |

| G1 0.4B | 3 月 25 日(已发布) |

| G1 1.5B | 4 月 29 日(已发布) |

| G1 2.9B | 5 月 中旬 |

我们也在同时准备更大更优的数据集 World v3.7。World v3.7 数据集的准备工作即将完成,届时将开始训练 RWKV7-G1 7B 模型。

加入 RWKV 社区

欢迎大家加入 RWKV 社区,可以从 RWKV 中文官网了解 RWKV 模型,也可以加入 RWKV 论坛、QQ 频道和 QQ 群聊,一起探讨 RWKV 模型。

- 📖 RWKV 中文文档:https://www.rwkv.cn

- 💬 RWKV 论坛:https://community.rwkv.cn/

- 🐧 QQ 频道:https://pd.qq.com/s/9n21eravc

- 📺 BiliBili 视频教程:https://space.bilibili.com/3546689096910933

欢迎大家基于 RWKV-7 进行创业、科研,我们也会为基于 RWKV 的项目提供技术支持。

如果您的团队正在基于 RWKV 创业或开展研究,请联系我们!(在"RWKV元始智能"微信公众号留言您的联系方式,或发送邮件到"[email protected]"。)