阿里通义团队开源新一代数学模型Qwen2-Math,包含1.5B、7B、72B三个参数的基础模型和指令微调模型。

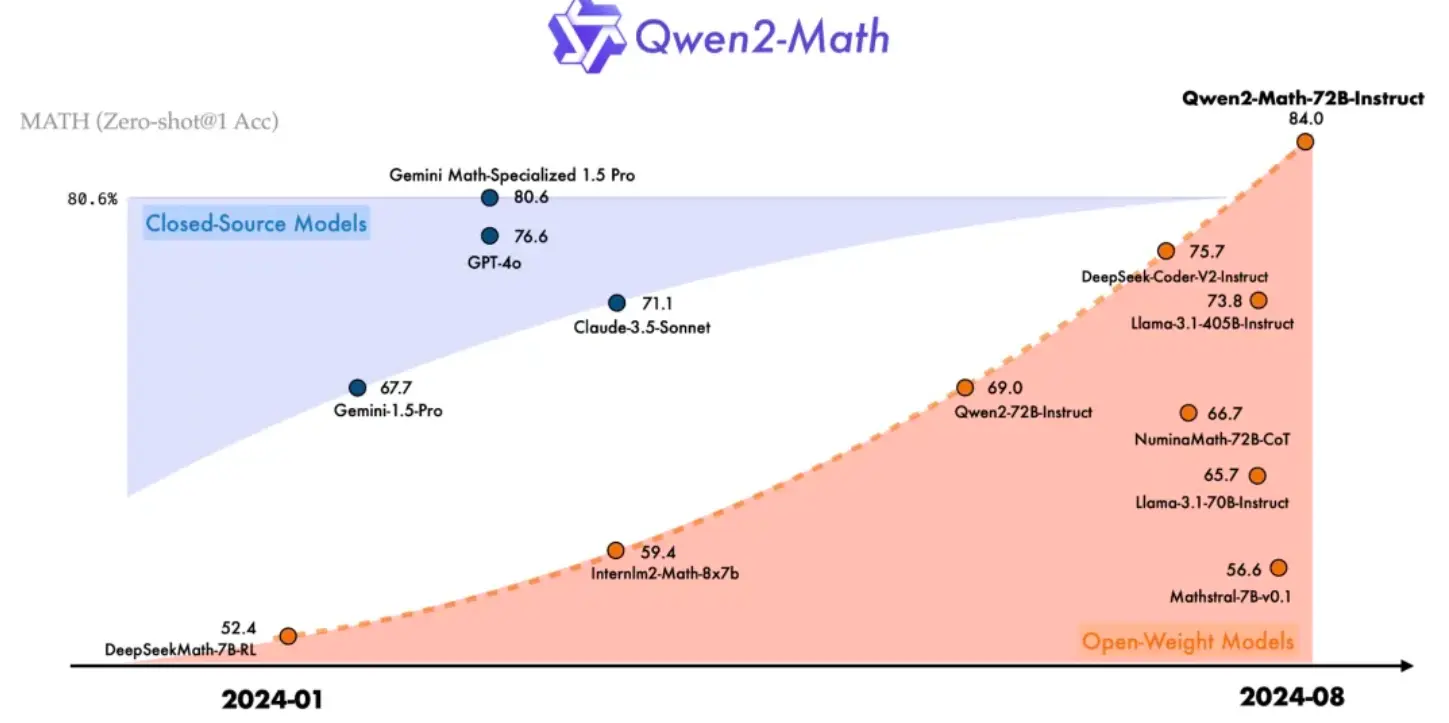

Qwen2-Math基于通义千问开源大语言模型Qwen2研发,旗舰模型 Qwen2-Math-72B-Instruct在权威测评集MATH上的得分超越GPT-4o、Claude-3.5-Sonnet、Gemini-1.5-Pro、Llama-3.1-405B等,以84%的准确率处理了代数、几何、计数与概率、数论等多种数学问题。

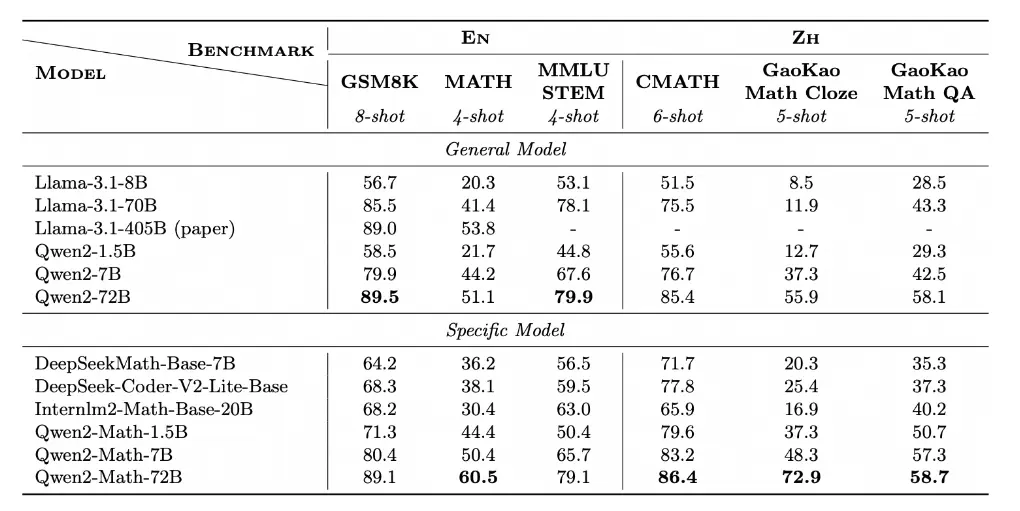

项目团队在三个广泛使用的英语数学基准 GSM8K、Math 和 MMLU-STEM 上评估了 Qwen2-Math 基模型。以及评估了三个中国数学基准 CMATH,GaoKao Math Cloze 和 GaoKao Math QA。所有评估均使用 Few-shot CoT 方式。

按照Qwen团队的说法,他们在预训练和微调数据集上都进行了去污染处理。具体来说,对于预训练数据,针对数学数据集,包括 GSM8K、MATH,并移除与测试集有显著重叠的样本。移除了有13-gram重复且最长公共子序列比例大于0.6的训练样本。对于微调数据,移除了更多与 GSM8K、MATH、Aqua、SAT Math、OlympiadBench、College Math、AIME24、AMC23 等数据集有重叠的正例污染样本,使用了同样的过滤方法

Qwen2-Math还计划推出支持英文和中文的双语模型,并开发多语言模型,这一举措将进一步扩大Qwen2-Math的应用范围。