来自俄罗斯斯科尔科沃科学技术研究院的科研团队最新研发了一个名为 HapticVLM 的多模态触觉系统,材料识别准确率高达 84.7%。

根据介绍,HapticVLM系统的技术核心体现在其精巧的架构设计上。系统巧妙地融合了深度卷积网络与视觉语言推理技术,实现了从视觉信息到触觉反馈的无缝转换。整个识别过程如行云流水般顺畅:系统首先通过先进的ConvNeXt架构对物体进行深度扫描,精准识别出是金属的冰冷坚硬、木材的温润质朴,还是织物的柔软细腻。随后,系统会生成极其稳健的视觉嵌入数据,为后续的材料识别提供坚实的数据基础。

HapticVLM还具备了环境感知的智慧。借助最新的Qwen2-VL-2B-Instruct视觉语言模型,系统能够智能推测周围环境的温度状况,并将这一信息seamlessly整合到触觉体验中。

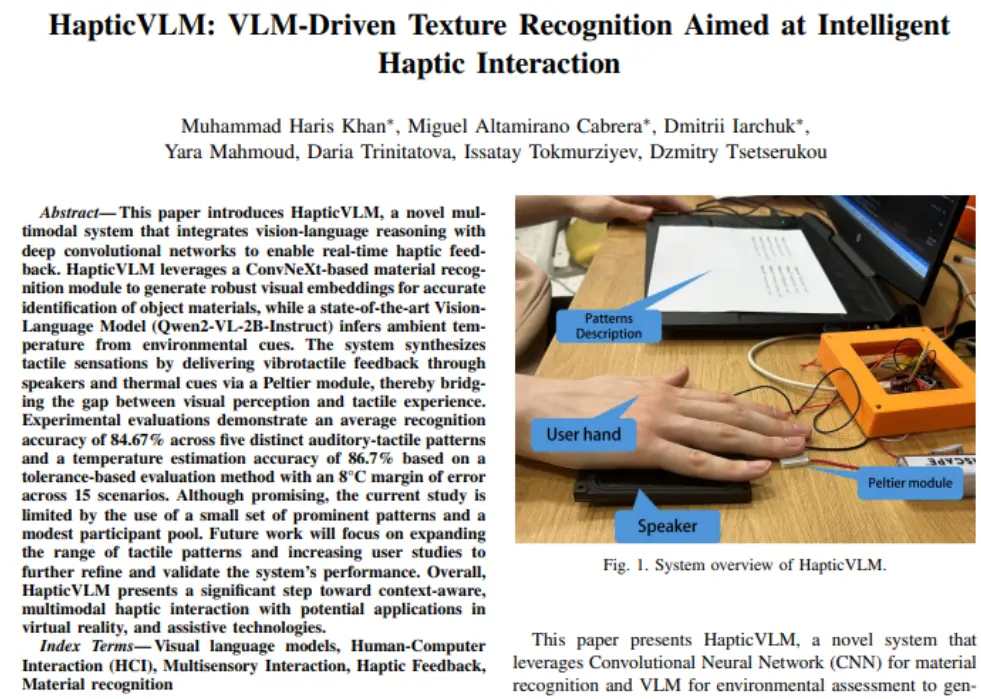

当用户的手指轻抚虚拟物体表面时,HapticVLM会通过高精度扬声器产生与特定材质完美匹配的振动反馈。这些振动并非简单的机械震动,而是经过精密计算的复合波形,能够准确模拟金属表面的坚实感、木质纹理的粗糙感,以及丝绸面料的顺滑感。每一次触碰都能带来令人信服的真实感受。

通过集成的帕尔贴模块,HapticVLM能够提供精确的动态温度变化,让用户真切感受到金属的冰冷、木材的温和,甚至是刚刚烘焙完成的面包所散发的温暖。

实验数据表明,在涵盖五种不同听觉触觉模式的综合测试中,系统平均识别准确率达到了84.67%,这一成绩在同类技术中堪称翘楚。在15种复杂环境场景的温度估算挑战中,系统表现出了86.7%的超高准确率。

不过,研究团队也坦诚当前系统存在的局限性,并明确了未来的发展方向。团队计划在触觉模式的广度和深度上进一步拓展,同时加强用户体验研究。

HapticVLM系统的应用前景极其广阔,几乎涵盖了所有需要触觉交互的数字化场景。在虚拟现实游戏中,玩家将能够真实感受到剑刃的锋利和盔甲的厚重。在在线购物平台上,消费者可以在购买前就体验到商品的真实手感。在远程医疗领域,医生能够通过触觉反馈进行更精确的远程诊断。在教育培训中,学生可以通过触觉体验更深入地理解物理和化学知识。