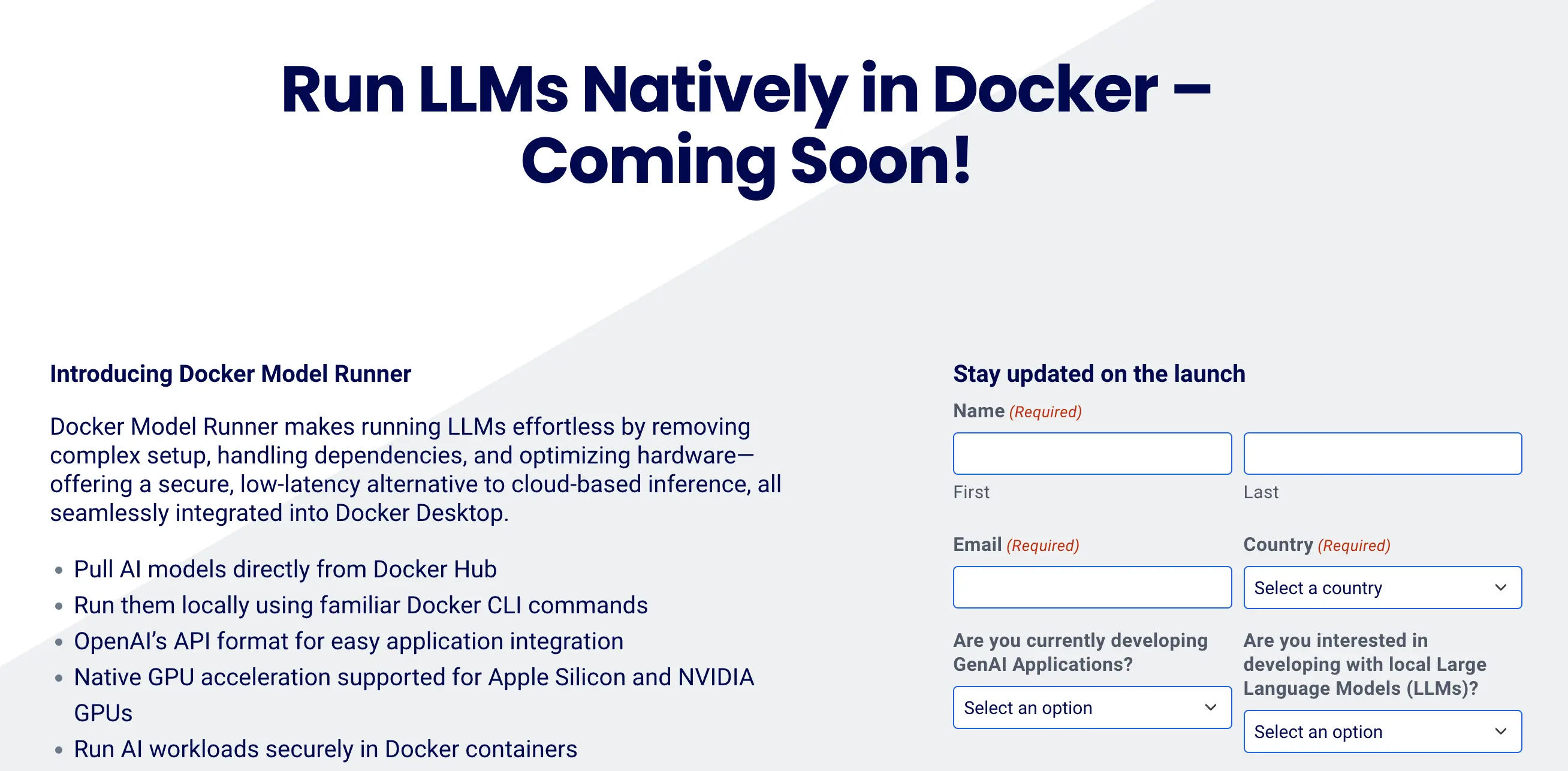

根据Docker官网消息,其即将推出Docker Model Runner工具,旨在通过容器化技术简化LLM本地运行流程。

其主要功能包括:

- 模型获取:支持从Docker Hub直接获取AI模型,简化配置流程。

- 操作便捷:通过Docker命令行工具使用,符合开发者日常操作习惯。

- 接口兼容:适配OpenAI标准接口,方便现有项目集成。

- 运行效率:支持苹果芯片和NVIDIA显卡加速,提升本地计算性能。

- 安全隔离:沿用Docker容器技术,保障运行环境的安全性。

当前开发者普遍使用ollama开源工具部署AI模型。相比而言,Docker Model Runner对已在使用容器技术的开发者具有天然适配优势。而ollama作为成熟的开源工具,拥有丰富的模型支持和活跃的社区资源。

有意思的是,ollama本身也支持在Docker环境中运行,这为用户提供了更多选择空间。