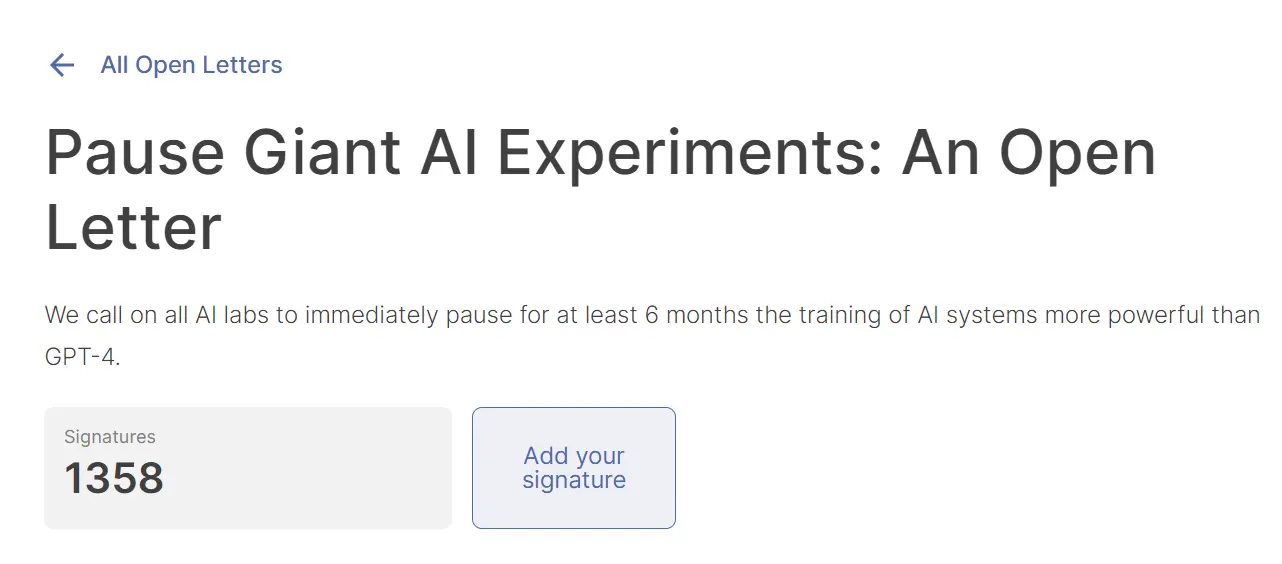

马斯克 (Elon Musk)、苹果联合创始人 Steve Wozniak、图灵奖得主 Yoshua Bengio 等上千名行业高管和专家签署了一封公开信,呼吁所有 AI 实验室立即暂停对比 GPT-4 更强大的 AI 系统的训练至少 6 个月。并表示,这种暂停应该是公开的和可验证的,且包括所有关键参与者。如果不能迅速实施这种暂停,政府应介入并暂停。

这封由非营利组织未来生命研究所 (Future of Life Institute) 发表的信中,详细阐述了具有强大竞争能力的 AI 系统可能会给人类社会和文明带来的风险。

大量研究以及一些顶级 AI 实验室的结果表明,具有人类竞争智能的 AI 系统可能对社会和人类构成深远的风险。正如被广泛认可的 Asilomar AI 原则中所述,高级 AI 可能代表地球生命史上的深刻变化,应以相应的谨慎和资源进行规划和管理。不幸的是,这种级别的规划和管理并没有发生;尽管最近几个月 AI 实验室陷入了一场失控的竞赛,以开发和部署更强大的数字思维,但没有人 —— 甚至他们的创造者都无法理解、预测、或可靠地控制。

当代人工智能系统现在在一般任务上已经具备了与人类竞争的能力。我们必须扪心自问:我们是否应该让机器用宣传和谎言充斥我们的信息渠道? 我们应该自动化所有的工作,包括有成就感的工作吗?我们是否应该发展最终可能在数量上超过我们、智慧上超越我们、淘汰并取代我们的非人类思维?我们应该冒险失去对我们文明的控制吗?这样的决定绝不能委托给未经选举的技术领袖。 只有当我们确信它们的影响是积极的并且它们的风险是可控的时候,才应该开发强大的人工智能系统。这种信心必须有充分的理由,并随着系统潜在影响的大小而增加。OpenAI 最近关于通用人工智能的声明指出,“在某些时候,在开始训练未来系统之前进行独立审查可能很重要,并且对于最先进的努力来说,同意限制用于创建新模型的计算的增长速度。” 我们同意。那一点就是现在。

公开信建议 AI 实验室和独立专家应该利用这次暂停,共同开发和实施一套用于高级 AI 设计和开发的共享安全协议,并由独立的外部专家严格审核和监督。“这些协议应确保遵守它们的系统是安全的,无可置疑”。

与此同时,AI 开发人员必须与政策制定者合作,以显着加快开发强大的 AI 治理系统。至少应包括:

- 专门负责 AI 的全新的有能力的监管机构;

- 监督和跟踪高能力的 AI 系统和大型算力池;

- 注明出处和水印系统,帮助区分真实和合成、以及跟踪模型泄露;

- 健全的审计和认证生态系统;

- 对人工智能造成的伤害进行责任认定;

- 为人工智能安全技术研究提供强大的公共资金;

- 以及资源充足的机构来应对人工智能将造成的巨大的经济和政治破坏(尤其是对民主的破坏)。

“让我们享受一个漫长的 AI 夏天,而不是毫无准备地陷入秋天。”

信中并没有详细说明 GPT-4 所揭示的危险,但包括签署这封信的纽约大学的 Gary Marcus 在内的研究人员长期以来一直认为,聊天机器人是伟大的骗子,有可能成为虚假信息的超级传播者。但也有不同意见者,作家 Cory Doctorow 就将人工智能行业比作"pump and dump"计划,认为人工智能系统的潜力和威胁都被大量夸大了。

一些外媒也认为,这份公开信不太可能对人工智能研究的当前氛围产生任何影响。因为谷歌和微软等科技公司急于部署新产品,往往会把一些对安全和道德的担忧视而不见。但这也表明,越来越多的人反对现在这种“ship it now and fix it later”的方法;这种反对派意见有可能进入政治领域,供实际的立法者考虑。

值得一提的是,微软公司联合创始人比尔·盖茨近日也在他的个人博客中畅谈了 ChatGPT 和生成式人工智能对教育、医疗、生产力提升、公平等等方面的影响,并声称,GPT 是其一生中见到的两项最具革命性技术之一。

“我对这一刻同样兴奋。这项新技术可以帮助世界各地的人们改善生活。与此同时,世界需要制定道路规则,让人工智能的任何缺点都远远超过它的好处,让每个人都能享受这些好处,无论他们住在哪里,无论他们有多少钱。人工智能时代充满机遇和责任。”

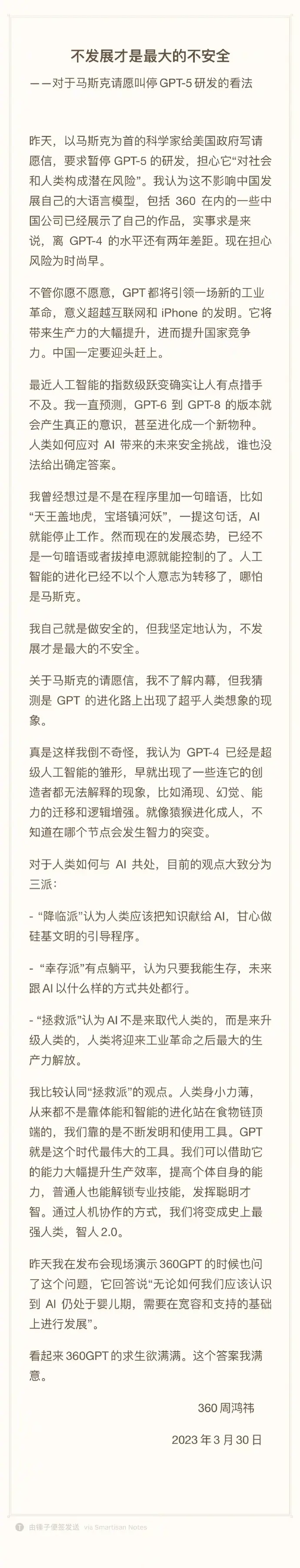

针对这一呼吁暂停 GPT-5 研发的联名公开信,360 创始人周鸿祎今天也在微博发表了自己的意见称,“我自己是做安全的,但我坚定地认为,不发展才是最大的不安全。关于马斯克的请愿信,我不了解内幕,但我猜测是 GPT 的进化路上出现了超乎人类想象的现象。”

周鸿祎认为,这不影响中国发展自己的大语言模型,包括 360 在内的一些中国公司已经展示了自己的作品,实事求是来说,离 GPT-4 的水平还有两年差距。现在担心风险为时尚早。

且“不管你愿不愿意,GPT 都将引领一场新的工业革命,意义超越互联网和 iPhone 的发明。它将带来生产力的大幅提升,进而提升国家竞争力。中国一定要迎头赶上。”

值得一提的是,这封联名信属于公开署名;任何人都可以申请,所以其署名的真假还有待进一步确认。事实上,这封信确实受到了很多专家的质疑,被指加剧“AI 炒作”。未来生命研究所也清理掉了一部分名单,并在验证每个签名时暂停了在信上显示更多签名。