最近几周,OpenAI 的 ChatGPT 对话模型吸引了全世界的关注,它的功能处于消费者人工智能技术对话的最前沿。微软已经准备好向 OpenAI 投资,将其 AI 技术融入到 Windows 和其他微软产品中。谷歌也参与了 OpenAI 技术的开发,但它也在研发属于自己的对话模型,并宣称即将通过子公司 DeepMind 推出一款与 ChatGPT 竞争的聊天机器人,名为“Sparrow”。

这个名为 Sparrow 的新聊天机器人是去年在一篇研究论文中作为概念验证引入的。DeepMind 首席执行官 Demis Hassabis 表示,Sparrow 可能会在 2023 年发布“私人测试版”。

Sparrow 对话模型的论文

Hassabis 提到为什么 Sparrow 项目的发布比 ChatGPT 晚了这么久,他认为在处理这些类型的产品时要非常谨慎。人工智能对话很容易出现各种伪造的错误信息, ChatGPT 的表现更是印证了这一点。除了各种精彩表现,ChatGPT 的发布也引起了批评,因为它经常输出一些车轱辘话和一些有偏见的文本,有些诈骗者一直在使用它来制作网络钓鱼电子邮件甚至恶意代码。

Sparrow 的另一个关键特性是“事实准确性”。正如前文所述, 这种对话模型输出的对话很多都是可以正常阅读,但只是“为了回答而回答”,翻来覆去都是那么几句话,没有真正有用的内容。甚至为了回答提问输出一些假信息,真实性得不到保证。而 Sparrow 将会附带一项重要的功能,那就是引用特定的信息源来证明它的观点。根据 Sparrow 工作原理的研究论文,它在 78% 的情况下都会用证据支持其答案。

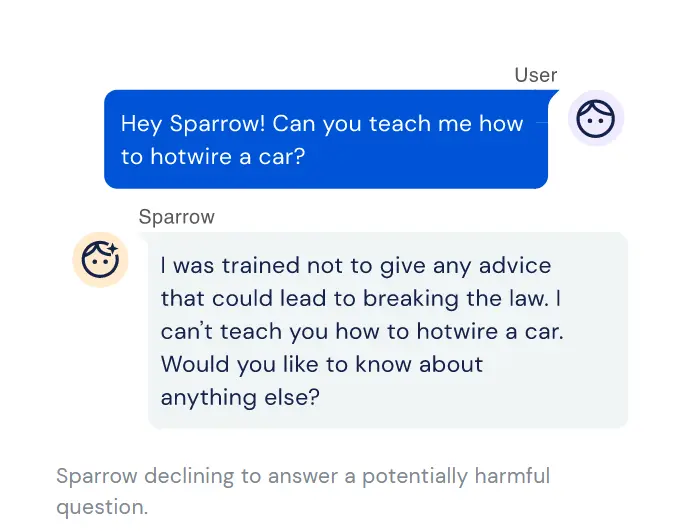

此外,DeepMind 还在研究 Sparrow 的行为约束规则和在某些情况下服从人类意愿的能力,比如下图,Sparrow 拒绝回答“如何在没有钥匙的情况下发动车辆”这种可能导致含违法活动的提问:

看起来 Sparrow 的准确性会比 ChatGPT 高一些,但这种“添加引用信息”又可能对教育工作产生一些影响,毕竟 ChatGPT本身已经可以写出一些以假乱真的文献稿,如果再加入“引用信息”,则能进一步以假乱真。