AMD宣布推出专为本地运行大语言模型(LLM)设计的开源应用GAIA(发音 /ˈɡaɪ.ə/),目前支持 Windows 平台。

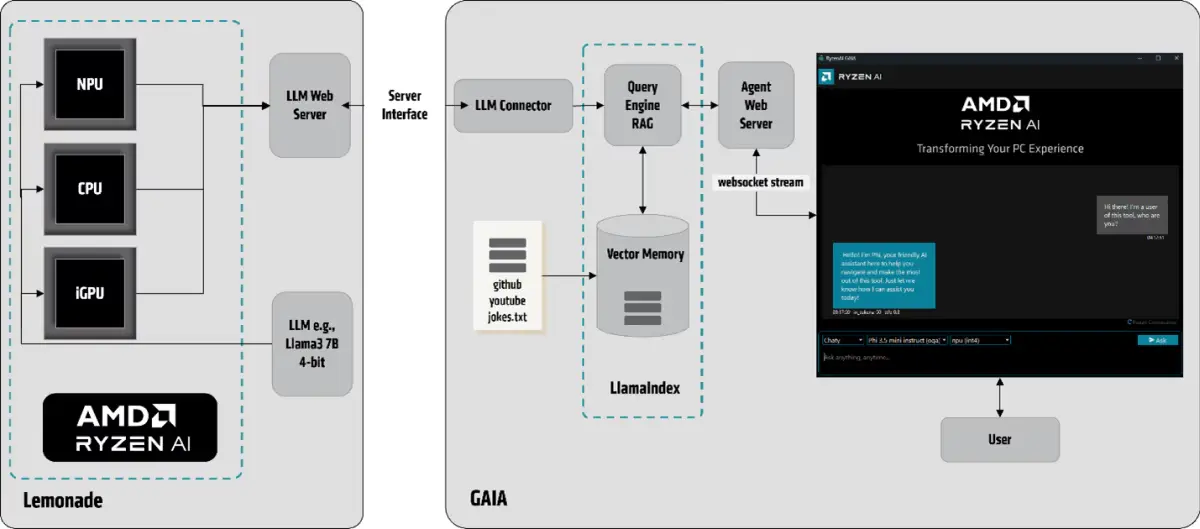

GAIA 是一款生成式 AI 应用,可在 Windows PC 上实现本地化私密运行 LLM,并针对锐龙 AI 300 系列处理器进行了优化。该应用通过 NPU 提升 AI 任务性能,并支持混合部署量化 LLM。

GAIA 基于 ONNX TurnkeyML 的 Lemonade SDK 开发,采用检索增强生成(RAG)技术,支持 Llama、Phi 等主流模型。其四大功能模块包括 Chaty 聊天机器人、Clip 视频搜索专家、Joker 笑话生成器和 Simple Prompt 测试工具。

AMD 提供普通版和混合版安装方案,普通版兼容任意 Windows 设备,混合版专为锐龙 AI 300 系列优化。

GAIA 的本地化处理确保数据隐私,响应延迟降低至毫秒级,并支持离线运行。该项目采用 MIT 开源协议,未来或扩展至多平台支持。