Dify.AI 宣布正式开源,并临时决定将开源协议从 AGPL 放宽到 Apache 2.0。Dify.AI 与飞蛾 (FEIE.WORK) 创始人表示:

开源!从第一天起我们就志在要代表中国团队做一个像 Docker、Stripe 那样的世界级产品,一个大模型能力上的 OS。虽然过去八周我们没日没夜才做出产品现在的样子,但即使要推倒重来我们也做好了准备,所以开源我们毫不犹豫。Dify 要在开源中学习、成长。

开源只是 Dify 的一小步,但这是全球开发者解锁 LLM 潜力的一大步。它目前还不完美,但在与社区共创、共建的过程中会成为全世界 Prompt 工程师最喜爱的产品。

No waiting list. No copy to China. 相信社区的力量!

Dify.AI 是一款开源且易用的 LLMOps 平台,旨在帮助开发者更简单、更快速地构建 AI 应用。Dify 提供了可视化的 Prompt 编排、运营、数据集管理等功能。你能在几分钟内创建一个 AI 应用,或将 LLM 快速集成到现有应用中,进行持续运营和改进,创造一个真正有价值的 AI 应用。

根据解释,“Dify”这个名字来源于“Define”和“Modify”这两个词。它代表了帮助开发人员不断改进其 AI 应用程序的愿景。“Dify”可以理解为“Do it for you”。

公告指出,从 3 月 1 日写下第一行代码至今 2 个多月,Dify.AI 共计包含 46,558 行代码,其中大约 30% 的代码是由 GPT 生产,目前已实现全部开源。

Dify.AI 核心能力

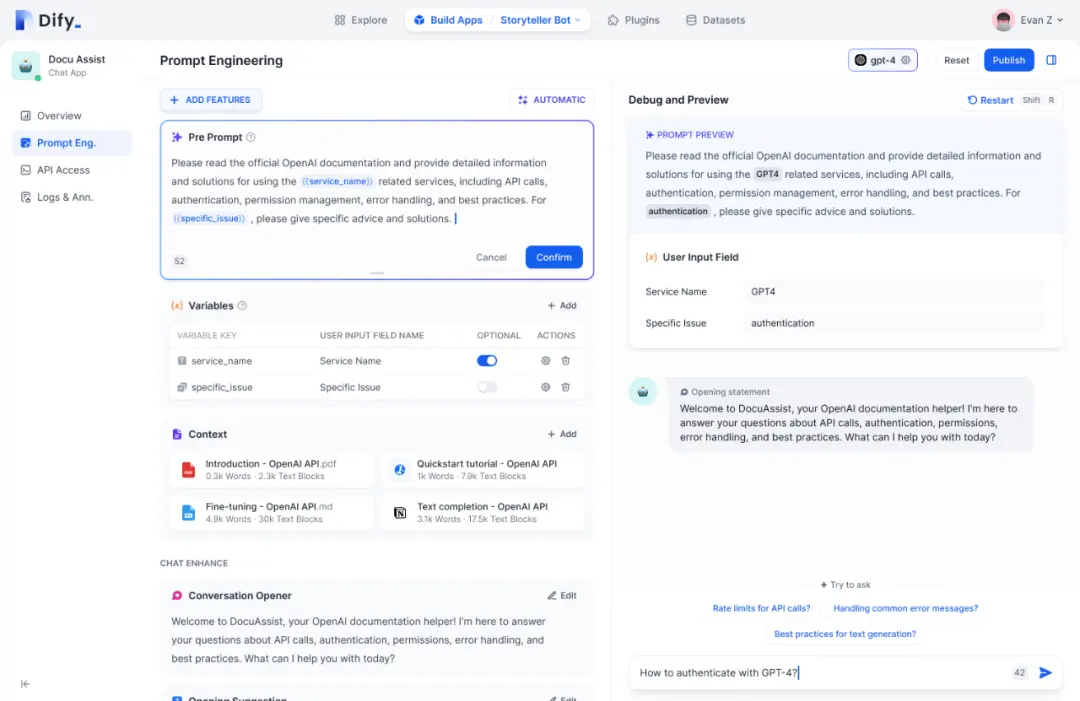

- 可视化编排 Prompt:通过界面化编写 prompt 并调试,只需几分钟即可发布一个 AI 应用。

- 接入长上下文(数据集):全自动完成文本预处理,使用你的数据作为上下文,无需理解晦涩的概念和技术处理。

- 基于 API 开发后端即服务。你可以直接访问网页应用,也可以接入 API 集成到你的应用中,无需关注复杂的后端架构和部署过程。

- 数据标注与改进:可视化查阅 AI 日志并对数据进行改进标注,观测 AI 的推理过程,不断提高其性能。

Dify 方面表示,其将以大语言模型的快速进步和社区反馈为动力,不断提升产品体验和能力边界,完善 Ops(持续运营)端平台功能。并长期规划以下产品功能:

-

插件能力。将插件纳入 App 编排之中,通过一个 API 或 WebApp 访问具备插件能力的 AI 应用。兼容 ChatGPT Plugins 标准插件。

-

数据集从 Web/Notion 导入。将支持更丰富的数据格式与导入来源。

-

更丰富的应用模版。提供开箱即用的应用模版,基于模版来迭代 prompt,增强应用能力。

-

数据监控。从运营成本、性能指标、用户留存指标等维度提供数据监测。未来将会逐步规划更丰富的监控维度。

-

开源模型支持。积极拥抱开源社区与项目,为开发者提供更丰富、开放的模型支持。