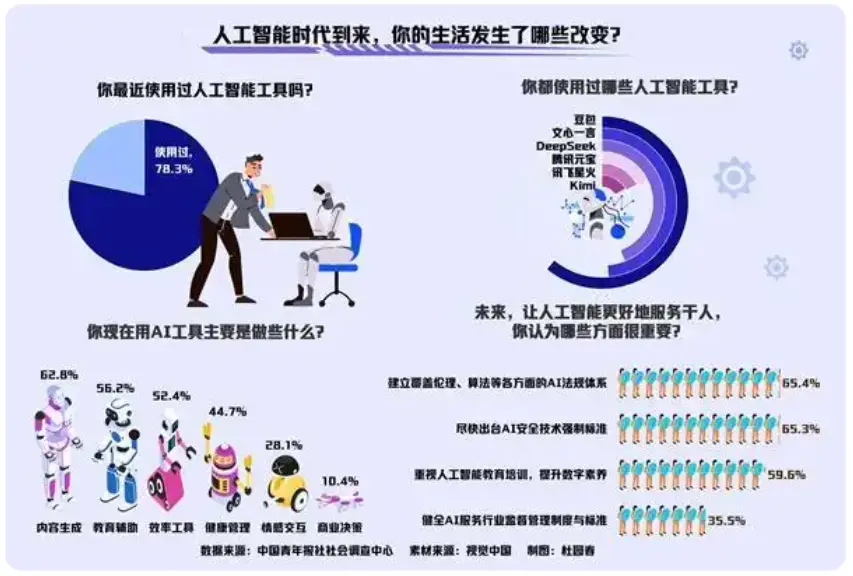

中国青年报社社会调查中心联合问卷网,对1340名受访者进行的一项调查显示,近八成受访者最近使用过人工智能工具。内容生成、教育辅助、效率工具是人们现阶段使用AI工具的主要用途。未来,让人工智能更好地服务于人,65.4%的受访者希望建立覆盖伦理、算法等各方面的AI法规体系。

调查显示,78.3%的受访者使用过人工智能工具,其中,近三成(27.7%)频繁使用。交叉分析显示,受访在校大学生(90.2%)使用比最高,其次是党政机关/事业单位工作人员(83.8%),国有企业工作人员(82.0%)排在第三位。不同年龄段的受访者中,年龄越大使用人工智能的比例越低,00后比例最高,为85.1%。

在各种不同的AI工具中,豆包是人们使用最普遍的工具,超六成受访者(61.0%)表示都在使用,其次是文心一言(48.6%),DeepSeek(44.1%)排在第三位。其他主要还有:腾讯元宝(17.9%)、讯飞星火(17.4%)、Kimi(16.5%)、ChatGPT(11.3%)、千问(10.7%)。

人们现在使用AI工具主要是做什么?调查显示,内容生成(文案撰写/图像视频生成)(62.8%)是第一用途,其次是教育辅助(知识问答/学习路径规划)(56.2%),排在第三位的用途是作为效率工具(文档处理/数据分析/信息检索)(52.4%),其他还有:健康管理(饮食建议/医疗咨询)(44.7%)、情感交互(心理疏导/虚拟陪伴)(28.1%)、商业决策(市场分析/投资建议)(10.4%)。

重庆大学法学院教授齐爱民提醒,虽然AI给我们的工作和生活带来了很多便利,但也需要注意,AI系统通常依赖于使用大量用户的数据进行训练和优化,如果使用不当或缺乏监管,可能导致个人隐私的泄露和个人信息的滥用,甚至威胁公共安全。国家有关方面和社会的方方面面都应加强公众对AI技术的深入了解,广泛普及网络安全知识和法律常识,提高整体安全防范意识。

未来,让人工智能更好地服务于人,65.4%的受访者期待建立覆盖伦理、算法等各方面的AI法规体系;65.3%的受访者指出应尽快出台AI安全技术强制标准;59.6%的受访者呼吁重视人工智能教育培训,提升数字素养;35.5%的受访者建议健全AI服务行业监督管理制度与标准。

齐爱民指出,应在法律制度层面构建人工智能系统化的保障体系。首先,制定《人工智能基本法》,坚持以人为本,从整体上确定人工智能的基本规则,为各细分领域人工智能单行法的制定提供法律依据和立法基础。

其次,针对人工智能的数据治理、算法歧视、算法黑箱等特殊法律问题,在《人工智能基本法》的基础上制定单行立法,针对性地解决人工智能数据治理问题与算法难题。

“在人工智能法律制度的建设过程中,应贯彻分类分级的规范思维,同时坚持技术中立性原则,保持适度的规则弹性以适应技术迭代节奏,保障制度的科学性、稳定性与灵活性。”

受访者中,00后占9.5%,90后占48.4%,80后占34.4%,70后占6.1%,60后占1.4%,其他占0.2%。中学生占0.4%,在校大学生占6.1%,党政机关/事业单位工作人员占9.7%,国有企业工作人员占20.3%,私营/外资企业工作人员占47.2%,个体户占7.7%,灵活就业/自由职业者占7.5%,无业/失业人员占0.6%,已退休占0.1%,其他占0.4%。