Google 近日修改了平台政策,禁止开发者使用其 Colaboratory 平台的服务进行 Deepfake 项目的研究,结束了以此为目的大规模使用该平台资源的情况。

Colaboratory 简称 Colab ,是 Google Research 团队开发的一款产品。在 Colab 中,任何人都可以通过浏览器编写和执行任意 Python 代码。它尤其适合机器学习、数据分析和教育目的。从技术上来说,Colab 是一种托管式 Jupyter Notebook 服务。用户无需设置,就可以直接使用,同时还能获得 GPU 等计算资源的免费使用权限,加速项目研究。

Colab 支持大多数主流浏览器,并且在 Chrome、Firefox 和 Safari 的最新版本上进行了全面的测试。

Deepfake 可以被训练成在视频片段上交换人脸,添加逼真的面部表情,使最终的视频效果看起来很真实,达到以假乱真的目的。这项技术本身基于机器学习,也是目前行业的热门研究领域,但却有不少人利用这项技术传播假新闻、伪造虚假的政治或色情视频。由于这项技术在道德上具有一定的争议,不少民众和企业对此都十分担忧。

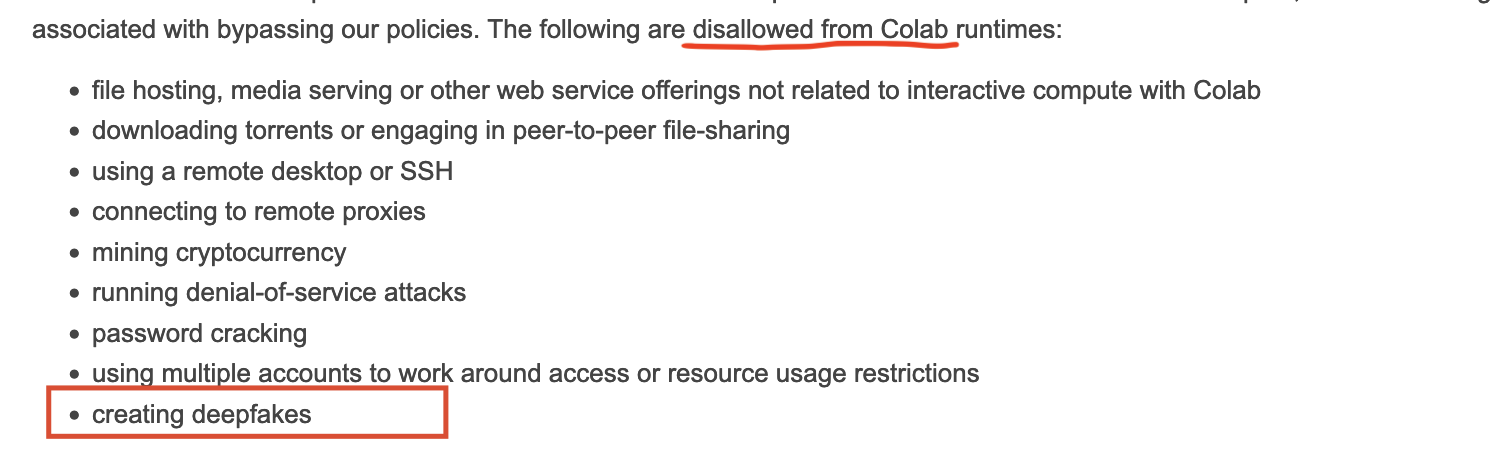

根据 archive.org 的网页历史数据,Google 在本月初修改了 Colab 的禁止项目列表,将 Deepfake 加入到黑名单中(如下图红框)。

如果开发者不顾黑名单列表,试图在 Colab 平台上继续训练 Deepfake 项目的话,开发者就会收到如下这样的错误提示:

你可能正在执行不被允许的代码,这可能会限制你在未来使用 Colab 的能力。请留意我们在 FAQ 中规定的禁止行为。

这项新限制的影响预计将在 Deepfake 领域产生深远影响,因为许多用户都会利用 Colab 的预训练模型来启动他们的项目。而且 Colab 本身使用起来十分简单,即使那些没有编程背景的人也能快速上手,这也是为什么有非常多的 Deepfake 教程都推荐使用 Colab 的原因。

目前还不知道 Google 执行这一政策是出于道德方面的考虑,还是对这些项目利用的计算资源负载过大而做出的限制。