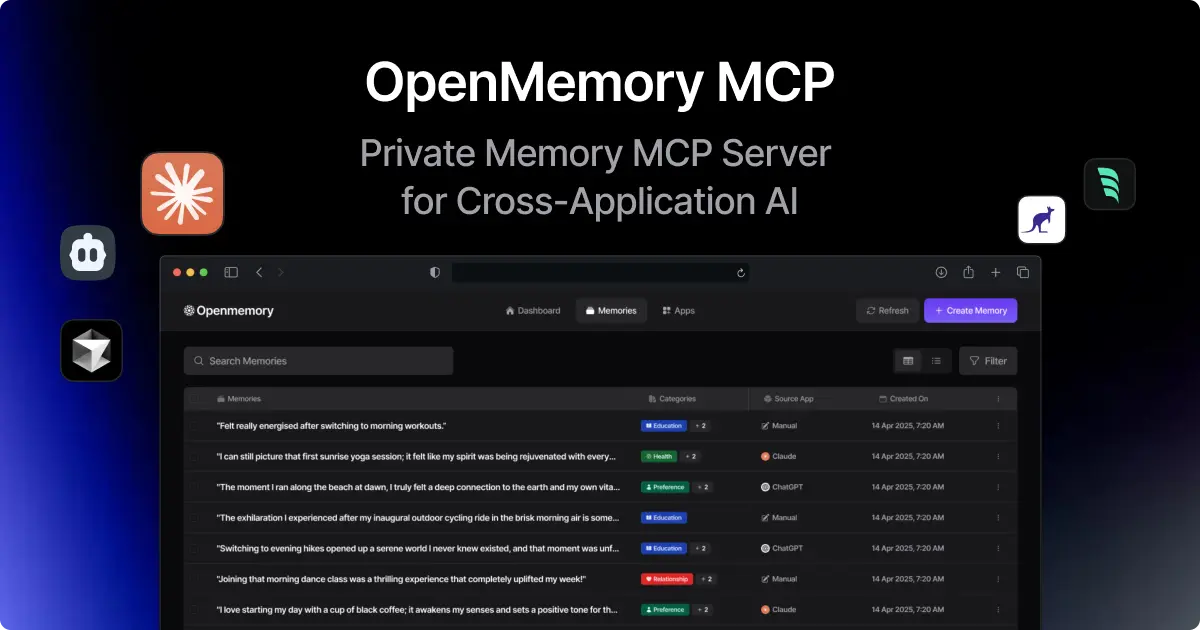

mem0团队推出了OpenMemory MCP,一个专为MCP(Model-Centric Programming)兼容客户端设计的私有化记忆解决方案。该工具旨在解决当前AI助手和开发工具普遍缺乏跨会话记忆的问题。

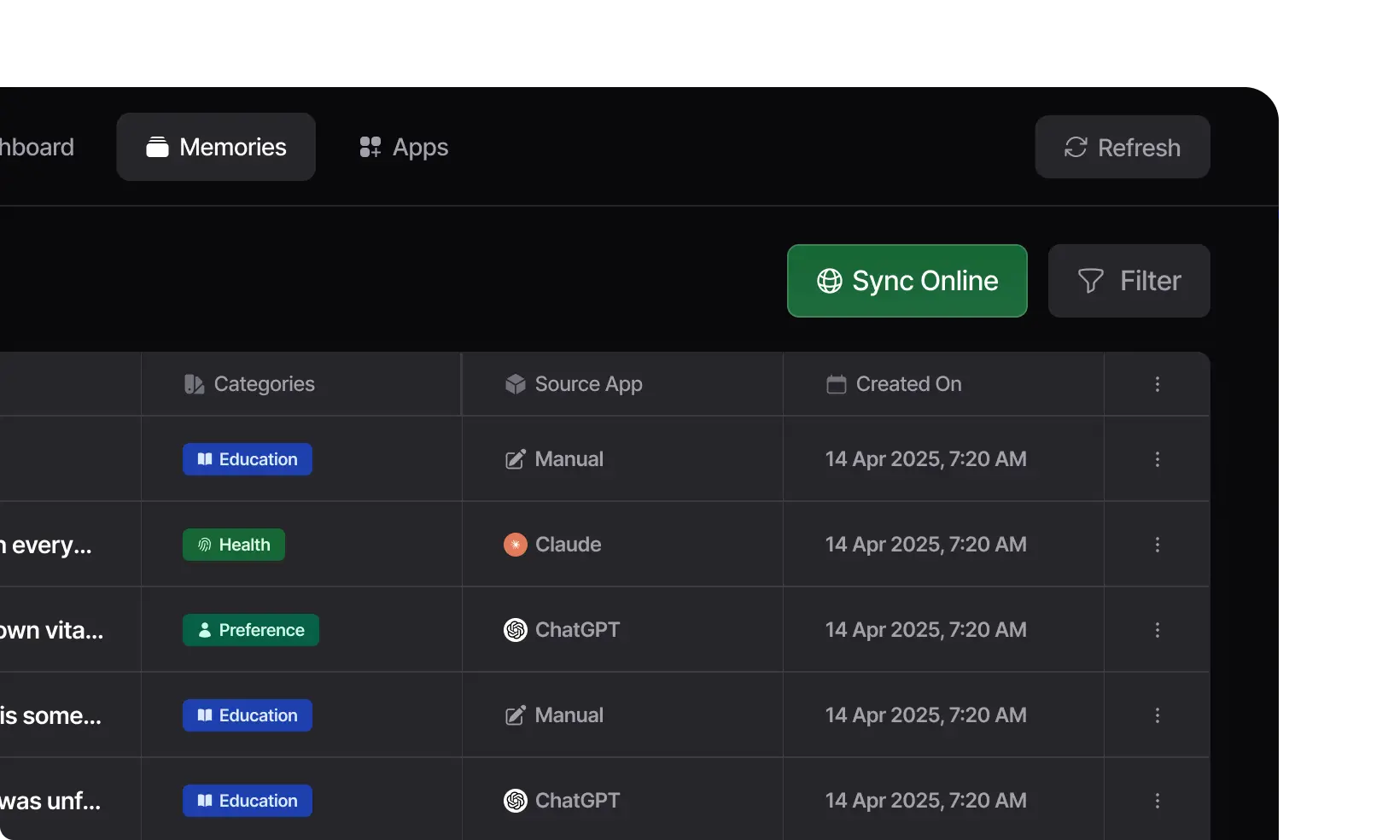

OpenMemory MCP支持在Cursor、Claude、Windsurf等多种AI应用之间共享和持久化记忆,所有数据处理均在本地进行,确保用户隐私。用户可通过简单的Docker设置部署该系统。

官方介绍如下:

OpenMemory MCP Server 是一个私有、本地优先的内存服务器,为 MCP 兼容工具创建一个共享的、持久的内存层。它完全在您的机器上运行,实现跨工具的无缝上下文传递。无论您是在开发、规划还是调试环境之间切换,您的 AI 助手都可以访问相关的内存,而无需重复指令。

OpenMemory MCP Server 确保所有内存都保持本地、结构化,并受您控制,没有任何云端同步或外部存储。

- 主页:https://mem0.ai/openmemory-mcp

- 文档:https://docs.mem0.ai/openmemory/overview

OpenMemory MCP 工作原理

基于模型上下文协议(MCP),OpenMemory MCP Server 公开了一组标准化的内存工具:

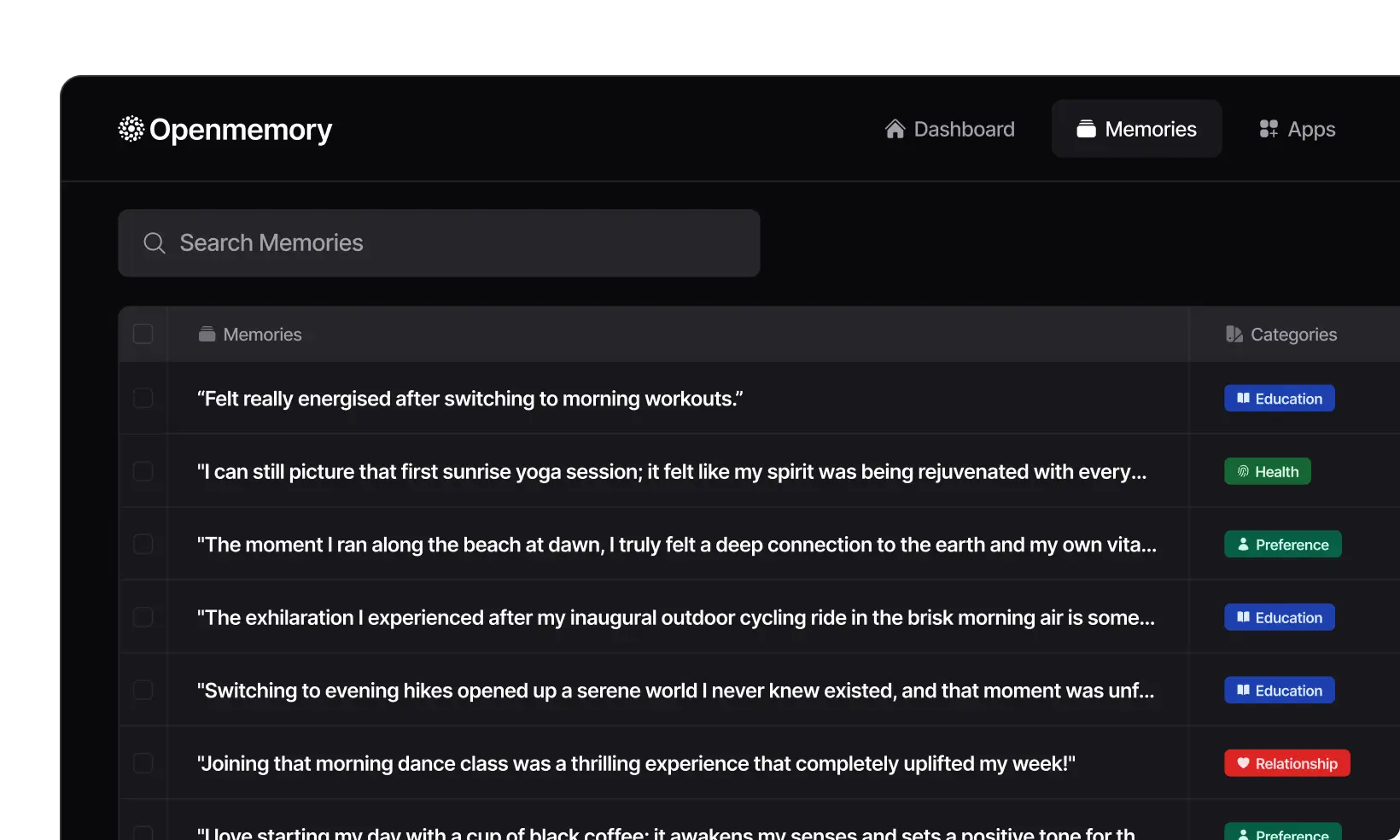

add_memories:存储新的内存对象search_memory: 检索相关的记忆list_memories:查看所有存储的内存delete_all_memories: 完全清除内存

任何兼容 MCP 的工具都可以连接到服务器并使用这些 API 来持久化和访问内存。